在 AI 的世界裡,大家通常只盯著「大腦」看(模型參數有多大、IQ 有多高)。但 2026 年初,DeepSeek 悄悄發布了一篇關於 mHC(流形約束超連接)的論文。這篇論文還沒變成產品,但敏銳的觀察者已經嗅到了不安的氣息。因為這一次,DeepSeek 不是在把大腦做大,而是在重寫 AI 的「脊椎」——也就是資訊如何在神經網路中流動。如果這項技術落地,它將顛覆的不是「模型有多聰明」,而是「推論有多便宜」。

以下是這場「脊椎進化史」的三個關鍵章節。

一、何愷明與 ResNet —— 拯救「失憶」的傳話遊戲 (2015)

在 2015 年之前,深度學習有一個巨大的詛咒:「越深,越笨」。

理論上,神經網路層數越多應該越聰明。但科學家發現,一旦超過 20 層,模型就會變傻。

這就像玩「傳話遊戲」:

第 1 層說:「明天早上九點開會。」

傳到 第 50 層,因為每個人都加了一點自己的理解(運算),最後那個人聽到的可能是:「明天......九......?」甚至全是雜訊。

這在數學上叫 「梯度消失(Gradient Vanishing)」。訊號在傳遞過程中衰減沒了。

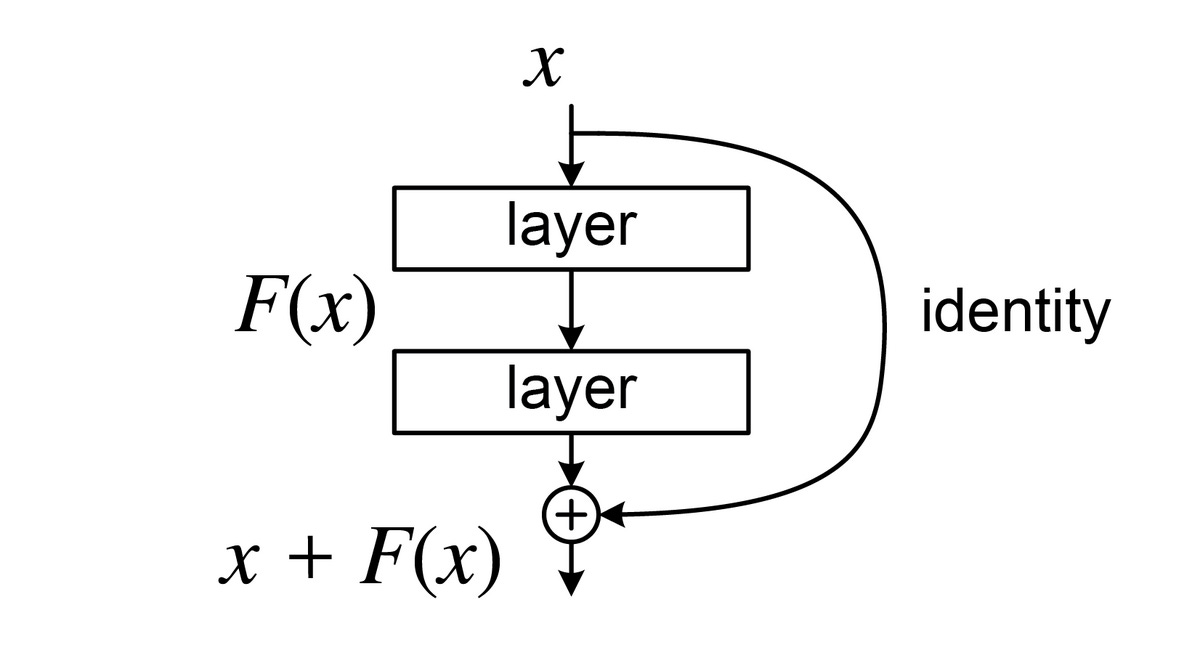

何愷明(Kaiming He) 提出了一個天才般的簡單解法:殘差連接(Residual Connection)。

他的邏輯是:

「如果你這一層聽不清楚上一句說什麼,沒關係,我給你一條捷徑(Shortcut),直接把原話傳給你。」

公式變成了:輸出 = 你的理解 F(x) + 原話 x。

這條捷徑(x)就像一條保命的高速公路,保證了不管蓋到幾百層,最原始的訊號永遠有一條路能通到底。

👉 ResNet 讓深度學習有了「脊椎」,AI 從此可以蓋摩天大樓。

二、Transformer —— 在「攪拌機」中全靠殘差救命 (2017)

兩年後,Google 發布了 Transformer(也就是 ChatGPT 的祖宗)。

Transformer 的核心機制是 Attention(注意力),它的本質是不斷地把不同的字(Token)的資訊「攪拌、混合」在一起,試圖找出關聯。

但這裡有個致命問題:「過度攪拌」。

如果你把一堆顏料不斷混合,最後會變成什麼?一坨均勻的灰色爛泥。

在數學上,這叫 「秩崩塌(Rank Collapse)」 —— 模型分不清「貓」跟「狗」,因為它們的特徵被攪拌到一模一樣了。

這時候,何愷明的「殘差連接」再次成為救世主。

Transformer 被迫在每一層攪拌後,都強行把 「原始身份 x」 加回來。

Attention 負責混合(尋找關聯)。

Residual 負責保持自我(保留特徵)。

👉 沒有殘差連接,就沒有 Transformer,也沒有今天的 GPT。它是防止 AI 腦袋變成漿糊的唯一防線。

三、DeepSeek mHC —— 「智慧交通網」 (2026)

時間快轉到現在。模型越來越大(GPT-4、Claude 3),單純的一條殘差高速公路開始塞車了。於是有人提出了 Hyper-Connections(HC,超連接):