隨著 AI 模型運算需求急升,新一代 GPU 功耗突破 1,000W、甚至上看 2,000W,傳統氣冷難以為繼,液冷成為必然。當前三大路線代表分別為 Vertiv、AWS 與 Microsoft:

Vertiv 與 Nvidia:主流「系統級」直接晶片液冷(Direct-to-Chip),透過 CDU 與完整基礎設計支撐大規模 AI 工廠建置。

AWS:以「列級」IRHX 模組化液對氣方案,兼顧成本與速度,快速升級全球既有資料中心。

Microsoft:前瞻「晶片級」微流體技術,在矽晶片背面蝕刻通道,冷卻液直接接觸晶片,效能領先但挑戰製程並衝擊供應鏈。

整體來看,Vertiv 技術將主導新建中心,AWS 提供存量升級範本,Microsoft 指向未來最終方向——散熱與晶片設計深度融合。理解這些差異,是掌握 AI 基礎設施競局的關鍵。

AI散熱的基石:Vertiv × Nvidia

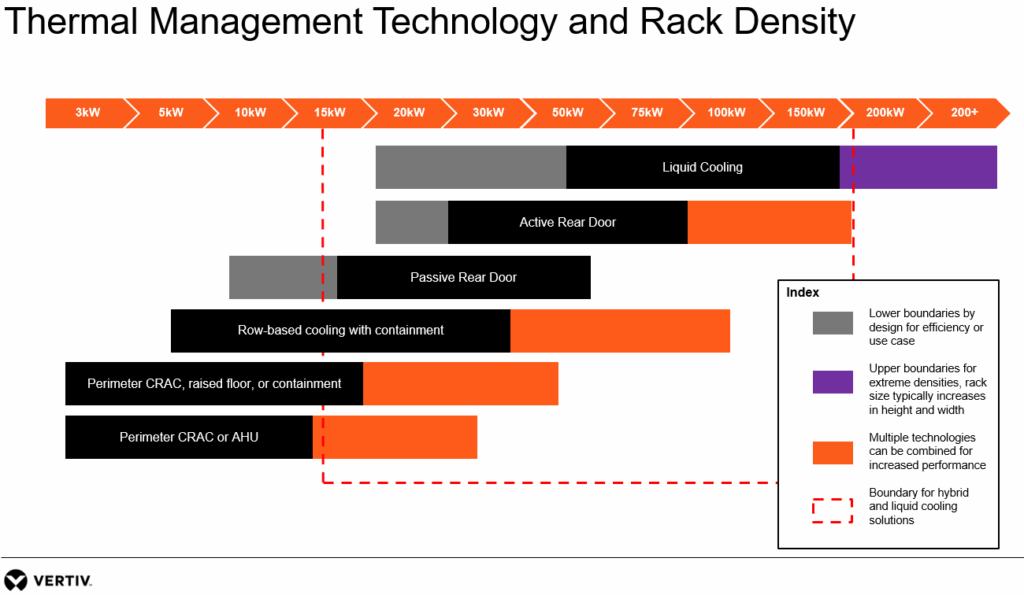

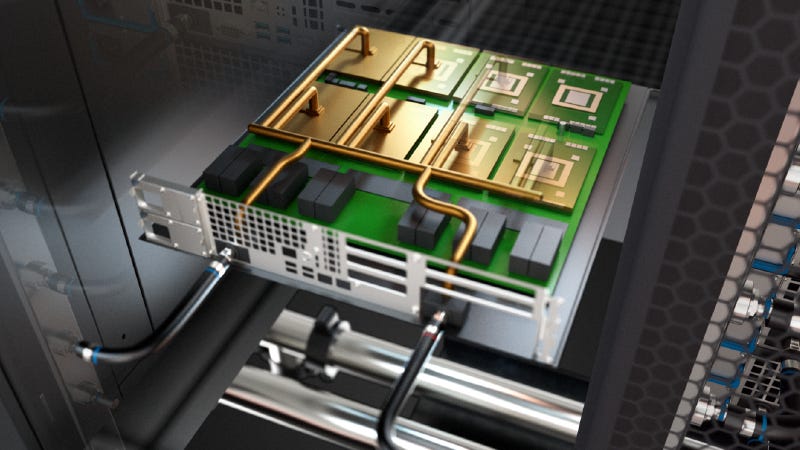

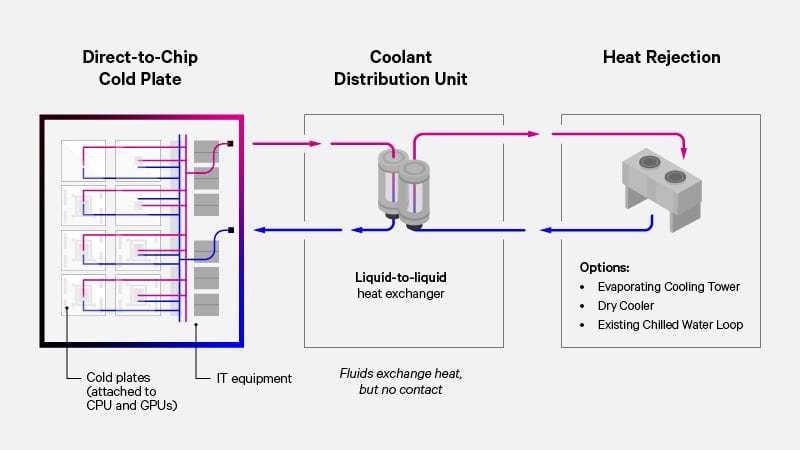

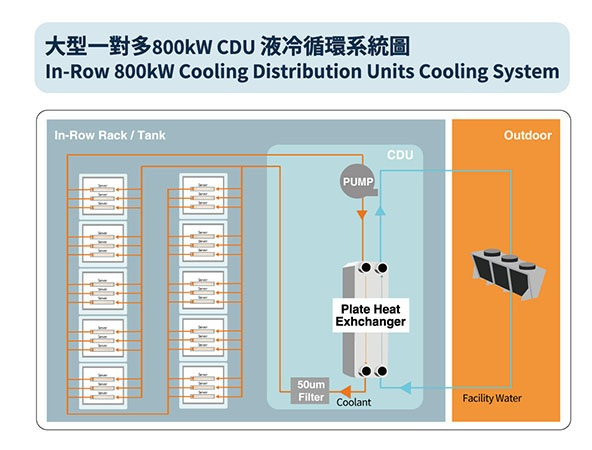

Vertiv 與 Nvidia 的深度整合,代表了當前主流的 直接晶片液冷(Direct-to-Chip, D2C) 技術,為「AI工廠」建立了系統級藍圖。

1.1 技術巔峰:D2C 液冷

冷板直接接觸晶片 IHS,冷卻液帶走熱量,效率遠優於傳統氣冷。

由冷板、CDU(液對液/液對氣)、管路構成完整迴路。

支援單相與效率更高的兩相冷卻,Vertiv 推出泵送兩相(P2P)方案。

1.2 GB200 參考架構

Nvidia GB200 NVL72 機櫃 TDP 高達 130–140kW,液冷成為必要。

Vertiv 與 Nvidia 共同開發 7MW 等級架構,涵蓋散熱、電力與機櫃設計:

混合式冷卻:72% 熱負載由液冷處理,其餘交由傳統空調。

大容量 CDU:從 70kW 到 2.3MW,涵蓋不同規模部署。

整合電力架構:UPS、PDU 與匯流排與散熱系統緊密結合,顯示 AI 時代部署單位是整個叢集而非單台伺服器。

1.3 戰略夥伴關係

Vertiv 為 Nvidia NPN 成員,提供預先驗證的參考設計,降低部署風險並加速建置。

其角色是 基礎設施賦能者,讓 Nvidia 晶片得以規模化落地。

策略核心在於工程化與整合,而非顛覆性原理創新,為企業提供低風險、高可靠性的選項。

總結

Vertiv 與 Nvidia 的合作,確立了當前 AI 資料中心最務實且可規模化的散熱模式,展現「現任者優勢」,與 Microsoft 高風險的晶片級創新形成鮮明對比。

務實主義者的路徑:AWS × IRHX

AWS 面臨的挑戰並非新建「綠地」資料中心,而是如何快速、低成本地升級其遍布全球的「棕地」設施。為此,AWS 推出自研 列間熱交換器(IRHX) 系統,展現高度務實的策略。

In-Row Heat Exchangers

2.1 架構剖析:模組化設計

流程:冷板為 GPU 降溫 → 液體送至列間風扇盤管 → 熱量排入熱通道。

解耦設計:拆分為三模組:配水櫃、獨立泵浦、列間風扇盤管。

優勢:可彈性增減風扇模組,依需求調整散熱能力,避免能源浪費,並能因應未來 GPU 功耗上升。

2.2 改造策略:存量優化

專為氣冷設計的既有中心打造,不需中央冰水系統,部署快、改造成本低。

列間設計節省機櫃空間,適應 AWS 的標準機房規格。

雖然散熱效率略遜液對液系統,但速度與成本優勢成為 AWS 擴張算力的關鍵。

2.3 產業影響:合作而非替代

市場初期擔憂 AWS 會削弱供應商角色,但實際上 IRHX 極可能與外部廠商共同設計並代工。

AWS 從單純採購者轉為共同設計者,鞏固並擴大供應鏈合作,展現其「設計垂直整合+製造外包」的混合模式。

總結

IRHX 不是最極致的散熱技術,但卻是最符合 AWS 全球足跡的解法:快速部署、低成本、靈活擴展。這種務實策略,讓 AWS 在 AI 賽局中維持速度與規模優勢。

革命性的飛躍:Microsoft × 微流體冷卻

不同於 AWS 的務實與 Vertiv 的工程化,Microsoft 直攻晶片本身,透過 微流體(Microfluidics) 開啟散熱典範轉移,可能徹底顛覆產業。

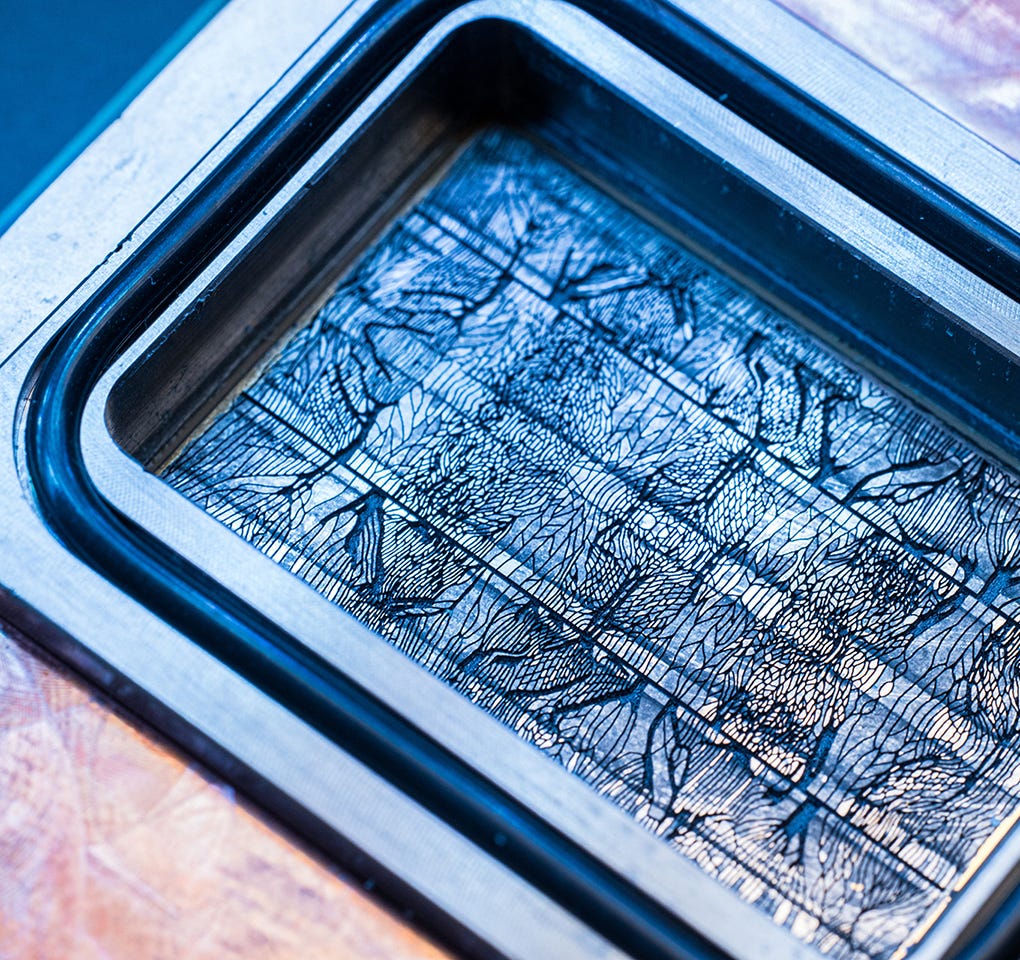

3.1 從冷板到矽脈絡

傳統路徑需穿越 TIM、IHS 等多層熱阻;微流體技術則在晶片背面蝕刻微通道,冷卻液直達矽晶片。

效能提升:散熱效率高出 3 倍,峰值溫升降低 65%。

微通道設計結合 AI 分析熱點,實現生物仿生式的精準降溫。

焦點從外部工程,轉向半導體製程與材料科學。

3.2 超越冷卻:新架構可能性

超頻:高效散熱讓晶片能短時突破額定頻率,降低伺服器數量與成本。

3D 堆疊:冷卻液可流動於層間,解鎖垂直堆疊設計。

廢熱利用:在高溫下仍能運作,排出熱水具能源再利用價值。

3.3 顛覆者的挑戰

需突破晶片蝕刻、封裝防洩漏與冷卻液配方等製程難題。

若成功,將淘汰 TIM、IHS、傳統冷板等元件,把散熱價值直接整合進晶片製造。

Microsoft 可將微流體技術融入自家 Azure Cobalt CPU、Maia AI 加速器,構建 Nvidia 難以追趕的架構優勢。

總結

微流體冷卻是一場「晶片級革命」:不只提升散熱,更可能重塑晶片設計、資料中心能源模式與整個散熱供應鏈。

Nvidia × 微通道水冷板(MLCP)

Nvidia 面對 2kW+ GPU 的散熱挑戰,推動 微通道水冷板(MLCP) 作為傳統冷板與 Microsoft 晶片級方案間的過渡橋樑,維持性能領先。

4.1 演化必然:突破「熱牆」

Rubin、Feynman 平台功耗上看 2.0–2.3kW,逼近現有冷板極限。

MLCP 與 Rubin 平台綁定,最快 2026 H2 商用。

屬於「防禦性創新」:在冷板範式內極限優化,延長既有技術壽命。

4.2 整合創新:設計與性能

IHS 與冷板合一:去除 TIM2,縮短熱傳導路徑。

微米級通道:比傳統冷板更細緻,顯著提升熱交換效率。

成本提升:單價為現有冷板 3–7 倍,熱管理在 BOM 中比重大幅上升。

量產挑戰:流體力學設計、洩漏風險與良率控制,需 3–4 季度成熟。

4.3 行業意涵:散熱前置化

散熱已成晶片架構定義的核心約束,而非後端問題。

Nvidia 直接指定散熱方案,界線模糊化,供應鏈角色前移。

掌握 MLCP 製程的廠商將成為高價值、戰略性供應商。

總結

MLCP 是 Nvidia 的「過渡性解法」:在短中期延續冷板模式,為 2kW+ GPU 鋪路,同時重塑晶片設計與散熱產業鏈的權力格局。

散熱技術路徑啟示

1️⃣資料中心營運商/超大規模業者

散熱已成戰略決策:在 改造存量(AWS模式) 與 投資新建液冷(Vertiv/Nvidia模式) 之間抉擇。

決策依據:現有資產、資本能力、上市時間壓力。

必須開始評估 晶片級冷卻 的長期潛力與採購策略影響。

2️⃣半導體設計者

散熱不再是外部問題,需自架構定義起深度整合。

路徑選擇:

MLCP模式:與散熱/封裝夥伴協同設計。

微流體模式:將散熱技術垂直整合進晶片本身。

3️⃣散熱基礎設施供應商

市場分化:短期系統級方案仍有巨大商機,長期則面臨晶片級冷卻威脅。

三大戰略要務:

深化與晶片設計者合作。

投資次世代 D2C/封裝級研發。

向冷卻液、泵浦、控制軟體等鄰近領域多元化。