Polaris Forge 1 園區案例研究

隨著 AI 技術以前所未有的速度發展,其對算力的需求呈指數級增長,AI 資料中心的設施並非傳統資料中心的簡單升級,而是從根本上為應對高密度運算帶來的極端電力和散熱挑戰而重新設計。

Applied Digital(APLD)位於北達科他州 Ellendale 的Applied Digital Polaris Forge 1園區,作為為 CoreWeave 量身打造的項目,為我們提供了一個剖析新一代AI基礎設施設計理念、供應鏈選擇和戰略考量的典型案例。

Applied Digital與CoreWeave在Ellendale的合作

Applied Digital的 Polaris Forge AI資料中心園區,主要租戶是CoreWeave。雙方簽訂的租賃協議初步涵蓋了250MW 的關鍵 IT 負載,並保留了額外增加 150MW的選擇權,使該園區的總潛在容量達到400 MW。

首座100 MW的資料中心(Polaris Forge 1)預計於2025年第四季度投入服務,而第二座150 MW(Polaris Forge 2)計劃於2026年中期完工。整個園區的設計總容量為 400MW,並具備超過 1GW 的電力容量接入潛力。

此項目並非對傳統資料中心的改造,而是一個從零開始、專為AI工作負載設計的「AI工廠」。其基礎設施的每一環節,從電力分配到散熱管理,目標要滿足液冷Nvidia GPU等高密度運算硬體所產生的極端物理需求。。

此案例揭示了一個核心的戰略轉變:地理位置的選擇不再是被動的成本考量,而是工程設計的重要環節:AI工作負載的兩大Opex:電力消耗和隨之產生的散熱,可以靠資料中心的地利位置得到更多的優勢 。

Applied Digital 選擇北達科他州 Ellendale,正是看中了其涼爽的氣候條件以及豐富且低成本的電力資源(可能包括所謂的「擱淺電力」,即發電量超出本地電網消納能力的電力)。這種選址策略將自然環境轉化為競爭優勢。涼爽的氣候使得資料中心在一年中的大部分時間裡可以採用「自然冷卻」,直接利用外部冷空氣進行散熱,從而大幅降低冷卻系統的能耗和運營成本。

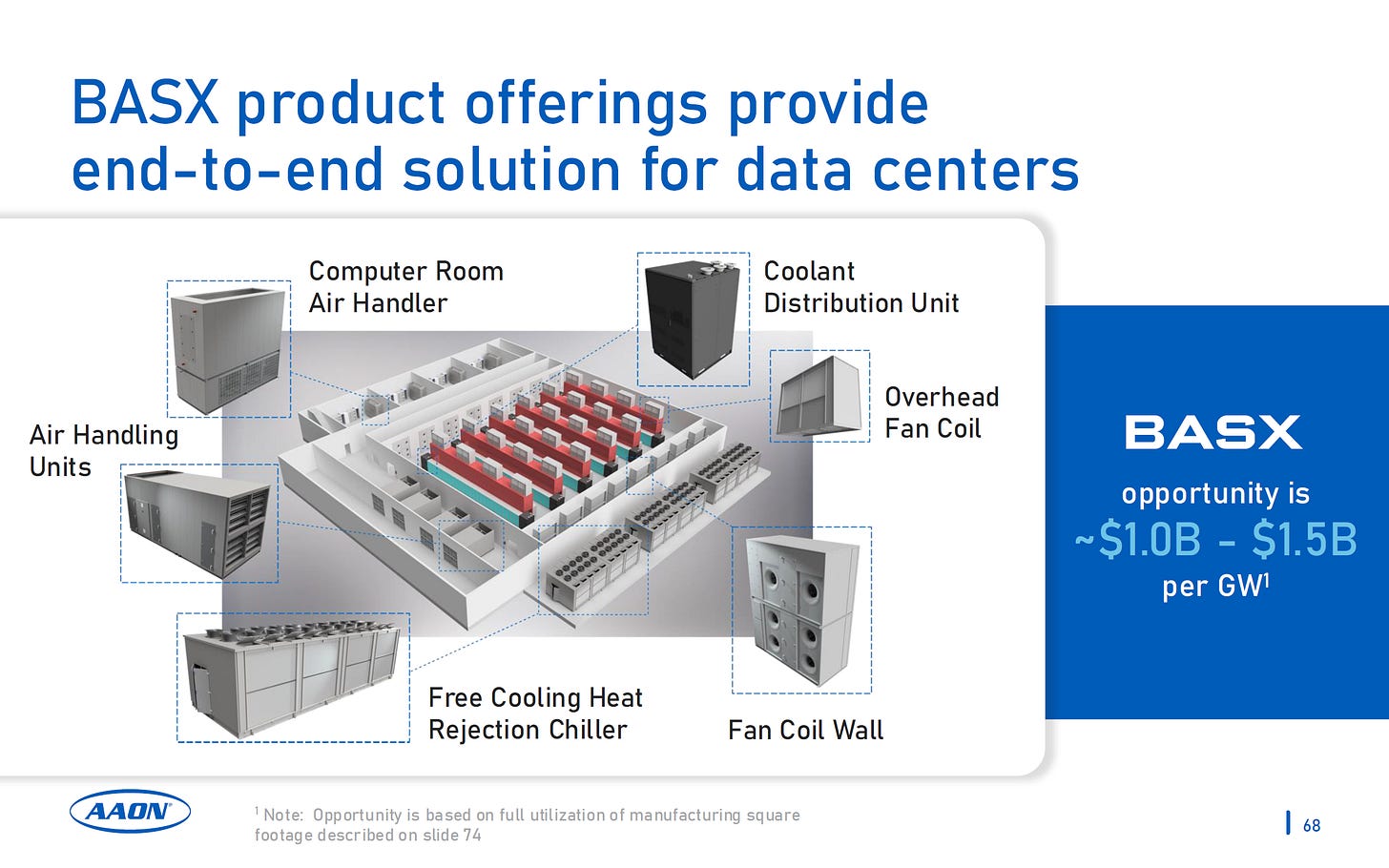

冷卻解決方案:BASX的客製化零耗水冷卻器系統

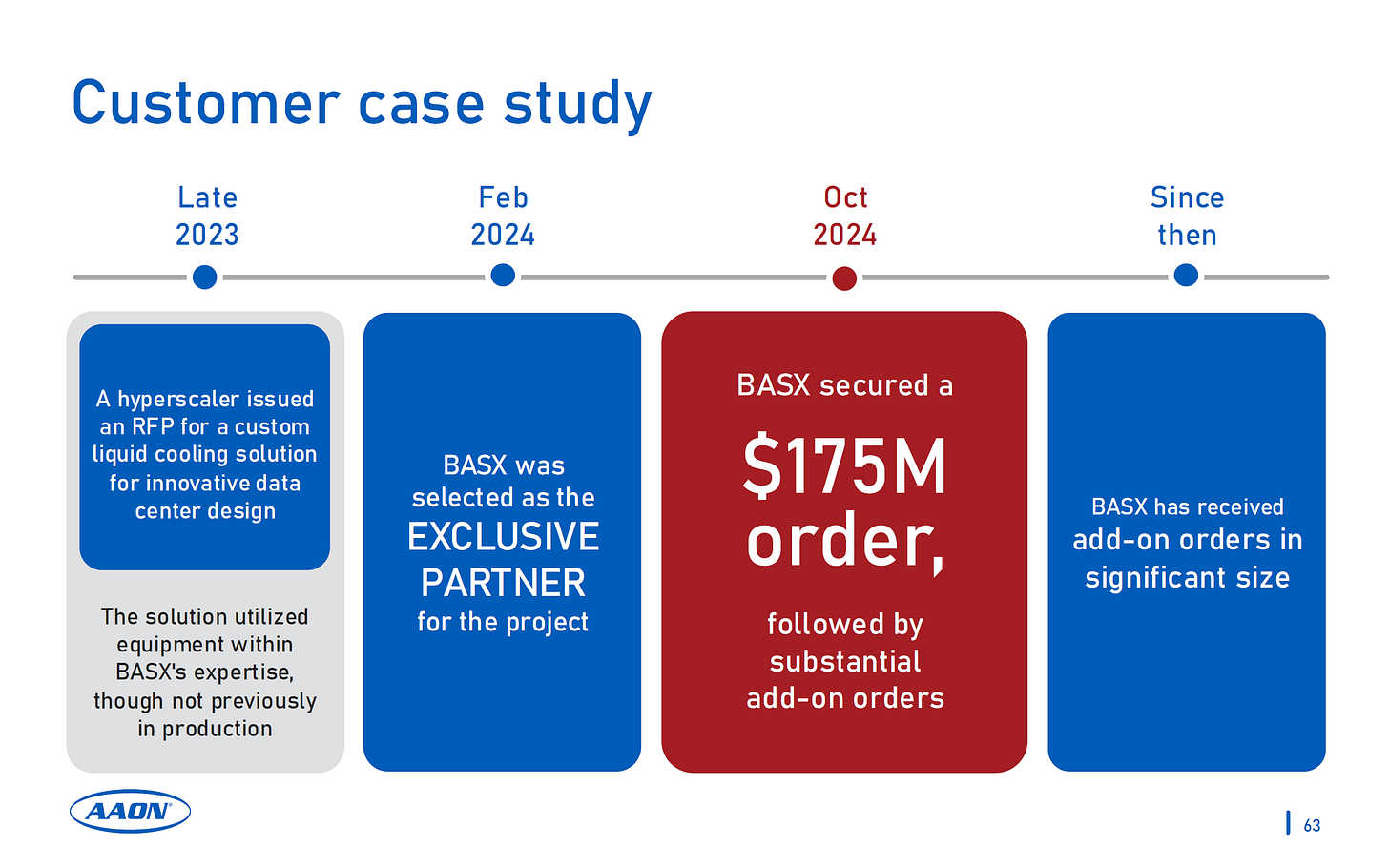

該項目的冷卻系統供應商為BASX,是暖通空調(HVAC)解決方案領導者AAON的全資子公司 。Applied Digital向BASX提出了一項挑戰,要求其開發一套能夠充分利用北達科他州氣候優勢,並滿足液冷伺服器嚴苛散熱需求的高效冷卻器系統。

BASX為此項目設計並製造了一套客製化的、零耗水的自然冷卻冷卻器系統。該系統專為寒冷氣候下的高效運行而優化,旨在應對液冷GPU產生的高熱通量。其核心技術亮點是「三模式」設計,能夠根據外部環境溫度的變化,在「完全自然冷卻」、「部分自然冷卻」和「完全機械製冷」三種模式之間動態切換,從而最大限度地利用自然冷源。該系統在運行過程中完全不消耗水資源,對於比傳統資料中心功率密度高出15至30倍的AI工廠而言,是一項重大突破。此外,系統的設計還考慮到了直達晶片(direct-to-chip)液冷技術的回水高溫特性,讓熱量更容易且高效地直接排放到周圍空氣中。

上圖直觀地展示了這套大規模冷卻裝置的物理形態,其中複雜且粗壯的戶外管道系統蜿蜒佈置,揭示了為一個數百MV級AI工廠進行熱管理所需的龐大實體基礎設施。

電力架構:ABB的專用中壓基礎設施

Ellendale 園區的電力基礎設施合作夥伴是全球技術巨頭 ABB。雙方在這個 400MW 的園區部署一套全新電力架構,初期設備訂單已於2024年底下單。ABB為該項目提供了核心的電氣基礎設施,其技術核心是HiPerGuard中壓(Medium Voltage, MV)靜態 UPS 及其配套的開關設備。

傳統資料中心普遍採用的低壓配電系統,但 GPU 極高功率密度使得傳統低壓方案在物理和經濟上都變得不切實際。ABB的中壓架構透過減少電力轉換的級數(從電網中壓直接到中壓UPS,再到機架端的低壓分配),顯著提高了能源效率,同時因減少了潛在的故障點而增強了系統的可靠性,並最終降低了運營成本。

轉向中壓架構的決策,並非簡單的技術升級,是物理定律所驅動的必然演進。根據電功率公式 P = V x I (功率 = 電壓 x 電流),要傳輸巨大的功率(如400 MW),要麼需要極高的電流,要麼需要更高的電壓。高電流會因電阻效應(Ploss = I2R)產生巨大的能量損耗,並轉化為廢熱,同時還需要使用極其粗大和昂貴的銅纜。

傳統資料中心因其功率需求相對較低,採用低壓配電是可行的。然而,對於功率密度高達15至30倍的 AI 工廠,低壓方案的物理和經濟成本將變得無法承受。因此,Applied Digital 與 ABB 合作採用中壓架構,是應對AI規模化所帶來的物理挑戰的唯一合理路徑。這預示著整個行業的一個重要轉折點:AI對電力的龐大需求正在重塑從變電站到伺服器機架的整個電網,所有未來的 GW 級資料中心園區都將遵循類似的設計藍圖。

AI資料中心的基礎支柱:超越電力與冷卻

雖然電力和冷卻系統是AI資料中心最為關鍵且挑戰最大的兩個子系統,但一個功能完備的AI工廠的建設還依賴於一系列其他必須提前規劃、採購和部署的基礎工程項目。這些項目同樣具有交付週期長、技術複雜度高的特點,共同構成了AI算力得以實現的物理基石。

電網接入與現場發電

確保穩定、足夠的電力供應是資料中心建設的首要前提。然而,獲得高壓電網的接入許可已成為行業面臨的主要瓶頸之一。據行業報告,目前從申請到最終實現併網,平均等待時間長達四年,這迫使開發商尋求具備現成電力接入條件的「帶電土地」(powered-land),或開發「電網後端」(behind-the-meter)的自主發電方案,例如建設現場的天然氣發電廠。此外,為了確保業務連續性,所有資料中心都必須配備備用電源系統,通常由柴油或天然氣發電機組構成,以應對主電網的任何中斷。

這些設施的規模是驚人的。一個大型AI園區的電力需求可高達 2GW,足以供應數百萬家庭的用電,這對地方乃至區域電網構成了前所未有的壓力。

資料中心行業與電力公司之間形成了一種複雜的共生關係:對於多年來需求增長平緩的電力行業而言,資料中心代表了一個全新的、可預測的、全天候運行的巨大負載增長點,這是一個巨大的商業機遇。然而,兩者之間存在著根本性的時間錯配:資料中心的建設週期通常為18到24個月,而電力基礎設施的建設——發電廠需要3到5年,高壓輸電線路則需要7到10年——遠遠慢於前者。

這種時間上的不匹配引發了一場系統性的挑戰,迫使資料中心運營商不得不涉足發電業務(例如自建發電廠),同時也迫使電力公司在需求尚未完全確定的情況下,進行大規模、高風險的資本投資。這種發展趨勢重塑能源行業的新格局,AI 資料中心的需求,成為全美乃至全球新建發電廠和電網升級的主要驅動因素。

IT與網路架構:機架、GPU與高頻寬互連

AI factory 的核心是成千上萬個,專為容納Nvidia GPU而設計的高密度機架。為了讓這些處理器協同工作,需要一個高速、低延遲的網路架構。通常採用 InfiniBand 或 400G 乙太網等先進技術,將數千台伺服器緊密連接成一個運算集群。整個網路系統還包括數英里長的光纖和電纜、大量的交換機、路由器和防火牆。

以Applied Digital的Ellendale設施為例,單一中心的設計目標是容納近 5萬個NVIDIA H100 級別的GPU。

整座建築,連同其內部數以萬計的、透過高速網路互連的GPU,整合成一台虛擬超級電腦。在這種模式下,網路架構不僅僅是數據傳輸的通道,它實質上扮演了這台超級電腦的類似「主機板」角色。這重新定義了資料中心的設計和建造流程。網路佈局、電力分配和冷卻系統等等,必須因應 GPU 集群而進行協同設計。

場地、實體結構與安全

超大規模設施需要巨大的物理空間。一個典型的大型資料中心佔地面積可達25萬平方英尺(約2.3萬平方公尺)或更多,而Applied Digital在Ellendale的第一座建築面積就達到了34.2萬平方英尺(約3.2萬平方公尺)。建設過程包括場地開發、地基工程以及多層建築的架設,通常會使用預製混凝土等現代建築技術以加快進度。

模型商與 hyperscalers 對 AI 算力需求的緊迫性,使得上市速度(speed-to-market)成為開發商的核心競爭力。整個行業正迅速轉向模組化和預製化施工。電力模組(power skids)、冷卻模組,甚至整個資料大廳的區塊,都在工廠內預先製造完成,然後運輸到現場進行組裝。

這一轉變意味著AI資料中心的建造過程正從傳統的商業建築業,向更接近先進製造業的模式演進。這種工業化的生產方式需要鉅額的工廠投資、全新的勞動力技能和高度複雜的物流協調能力。同時,這也意味著預製模組的供應鏈本身,成為了另一個潛在的瓶頸和需要密切監控的關鍵領域。

我們想像中的場景是:OpenAI 或 Microsoft 對 AI 算力需求孔急,ChatGPT 或 應用層要處理的 tokens 數呈指數增長,對 Nvidia 的 GPU 需求十分飢渴,此前的產能瓶頸在台積電 CoWoS 與 HBM;對於 AI 資料中心的建置,卻從未認真思考不只是電力瓶頸,電網升級、高壓電網併入、變電站基礎設施、因應 AI 資料中心而衍生的冷卻系統、UPS、備用發電機組等,這些關鍵組件公司根本應付不來,以至於交付週期空前延長。這種供應鏈的緊張狀況,正好為分析和預測未來 AI 算力的增長提供了一個獨特的視角。

識別關鍵路徑組件與採購瓶頸

資料中心建設的供應鏈正承受著巨大的壓力 。行業報告指出,交付週期最長、對項目進度影響最大的「關鍵路徑」組件主要集中在三大系統:電力分配設備(變壓器、開關設備)、備用電源(發電機組)和熱管理系統(冷卻器)。當然,作為運算核心的 GPU 也是。

這些延遲是由多種因素共同作用的結果,包括AI驅動的需求激增、關鍵原材料(如銅和電工鋼)的短缺、全球專業製造產能的限制以及物流運輸的挑戰。問題的嚴重性已經顛覆了傳統的項目管理流程,開發商現在需要在設施的詳細設計完成之前,就提前下達這些長週期設備的訂單,以鎖定稀缺的生產排程。

這樣爆發式增長,在重型電氣和機械設備行業引發了歷史性的「牛鞭效應」(bullwhip effect)。牛鞭效應是供應鏈管理中的一個經典現象,指需求端微小的波動會沿著供應鏈向上游逐級放大。在當前情境下,AI算力需求的突然、劇烈增長,構成了一個巨大的、始料未及的需求信號。

這個信號衝擊了一個高度專業化、產能彈性極低的工業製造基礎(例如高壓變壓器製造商),這些企業無法在短期內快速擴大產能。作為對初期延遲的反應,資料中心開發商開始超額訂購並提前數年下單,以確保未來的供應。

這種「恐慌性購買」行為進一步加劇了供應商的訂單積壓,形成了一個交付週期不斷延長、採購行為更加激進的惡性循環 。這使得準確的供應鏈預測變得空前困難,同時也空前重要。

AI時代的設備交付週期基準

為了具體量化供應鏈的緊張程度,下表根據2025年的行業數據,匯總了關鍵資料中心基礎設施組件的平均交付週期。這些數據清晰地揭示了當前建設項目面臨的時間制約。

這個表格不僅是一個數據列表,更是一個分析工具。它直觀地展示了項目進度中最主要的瓶頸所在(發電機和變壓器),其交付週期遠超過一年半,而其他組件的週期相對較短。通過註明延遲的根本原因,例如「銅短缺」或「嚴格的測試負擔」,該表格為理解供應鏈的複雜動態提供了深層次的背景。這些具體的數字是構建後續預測模型的基礎,直接回應了對AI建設物理制約進行量化分析的核心需求。

根本原因分析:解構空前延遲的驅動因素

當前供應鏈的延遲並非由單一因素造成,而是一個多重因素疊加的複雜問題。其根本原因可以歸結為以下幾個方面:

需求衝擊:由AI引發的訂單呈指數級增長,遠超出現有供應體系的承載能力。

原材料稀缺:全球範圍內用於製造重型設備的基礎材料,如銅、電工鋼、鋁和水泥,均出現供應緊張和價格上漲。

製造產能限制:能夠生產中壓變壓器等高度專業化設備的工廠數量有限,且擴產週期長、投資巨大。

勞動力短缺:無論是設備製造工廠的熟練技術工人,還是資料中心建設現場的專業施工人員,都面臨著嚴重的短缺 7。

地緣政治與物流問題:國際關稅、海運延誤和貨運價格的波動,為本已緊張的供應鏈增加了更多的不確定性。

這些因素共同作用,導致了當前交付週期被極度拉長的局面,並使得供應鏈管理成為AI基礎設施開發商面臨的最嚴峻挑戰之一。

綜合前述對AI工廠構成、建設流程及其供應鏈瓶頸的分析,可以構建一個核心論點:通過追蹤關鍵物理基礎設施的採購訂單,可以獲得一個強大的、具有前瞻性的視角,用以預測未來AI算力的部署節奏和規模。

核心論點:為何長交付週期能創造前瞻性信號

這一論點的邏輯鏈條清晰而有力:

大規模部署AI應用,必須依賴於海量的、專門建造的資料中心。

這些資料中心的建設,離不開電力和冷卻等關鍵基礎設施組件,而這些組件的平均交付週期長達18至24個月,甚至更久。

這些重型設備(如中壓變壓器、大型發電機組)是高度專用且不可替代的。它們必須在項目生命週期的最早期階段就下單採購,通常遠在設施投入運營的數年之前。

因此,一份得到確認的、價值數百萬美元的100 MW開關設備和變壓器採購訂單,是一個高保真度、非投機性的信號,它強烈預示著大約兩年後將有100 MW的資料中心容量投入使用。 這個信號的出現,遠早於GPU的安裝和項目產生收入,使其成為一個真正的領先指標。

驗證模型:以電力接入申請為先例

金融和行業分析師已經在實踐中採用了類似的指標。高盛證券的研究報告指出,歐洲公用事業公司收到的電力接入申請數量在過去幾年呈指數級增長,這被視為預測未來資料中心需求的關鍵「領先指標」。

獲得電力供應是任何資料中心項目啟動的第一步。開發商向電力公司正式提交一份連接400 MW負載的申請,是其將意圖轉化為具體行動的最早標誌之一。

基於此,可以構建一個「信號層級」模型,以評估不同階段信息的預測價值:

信號1(最早,投機性最高):公司高管的公開聲明、投資者電話會議中的規劃披露。

信號2(早期,可信度較高):向公用事業公司提交的針對特定MW負載的正式並網申請。這標誌著項目已進入初步規劃和可行性研究階段。

信號3(中期,可信度最高):已確認的、針對長交付週期設備(變壓器、發電機、冷卻器)的鉅額採購訂單。這代表著公司已投入大量資本,項目時間表基本鎖定,是預測未來產能的最可靠信號。

信號4(後期):獲得建築許可、下達GPU採購訂單。

信號5(滯後指標):設施調試完成、投入運營、產生收入。

在這個層級中,本報告所探討的「追蹤設備訂單」策略,處於一個理想的平衡點。它比併網申請更為具體和確定(因為涉及真實的資本支出),又比GPU訂單或設施完工早得多,從而提供了長達18至24個月的寶貴預測窗口。

追蹤AI建設的框架:數據來源與信號解讀

一個實用的預測模型需要系統性地監控以下幾類數據源:

上市公司財報與投資者關係:主要設備製造商(如 Schneider、Eaton、Vertiv、Caterpillar、Siemens、GE Vernova等)的財報和電話會議中,可能會披露其資料中心業務部門的訂單積壓情況。

行業與貿易出版物:專業媒體經常報導大型設備訂單或戰略合作夥伴關係(如ABB與Applied Digital的合作)。

供應鏈情報平台:利用專業的數據服務,追蹤海運提單、採購訂單和製造業活動數據。

公用事業公司文件:公開的公用事業委員會文件中,可能包含大型負載的並網申請記錄。

解讀這些信號的關鍵,是將設備訂單轉化為對應的MW容量。例如,一份特定型號發電機或冷卻器的訂單,通常對應其能夠支持的已知MW負載。通過在區域層面積累和分析這些信號,就可以繪製出一幅預測未來幾年資料中心容量增長的前瞻性地圖。

評估信號保真度:潛在噪音與緩解因素

必須承認,這個信號並非完美無瑕。存在一些可能干擾預測準確性的「噪音」:

訂單取消:儘管對於如此巨大的資本承諾而言較為罕見,但訂單仍有可能被取消。

重複下單:為對沖供應鏈風險,開發商可能向多家供應商下達訂單。

項目延誤:即使設備已運抵現場,許可審批或施工問題仍可能導致項目延遲投產。

非AI用途:部分設備可能用於傳統的企業資料中心。然而,當前100 MW以上級別的超大規模訂單,絕大多數都與AI基礎設施相關。

這些干擾因素可以通過交叉驗證來緩解。例如,將一份設備訂單與已知的並網申請和公司公告進行匹配,可以大大提高信號的準確性。此外,將分析重點放在最大規模的訂單上,也能有效過濾掉大部分非AI用途的噪音。

本報告的分析揭示了一個深刻的轉變:AI的發展已不再僅僅是軟體和晶片的競賽,它在根本上受制於重工業設備的製造和部署。物理基礎設施的供應鏈,正成為決定AI未來發展速度和規模的關鍵瓶頸。這種實體世界與數位世界的深度糾纏,將對市場格局、投資策略和公共政策產生深遠影響。

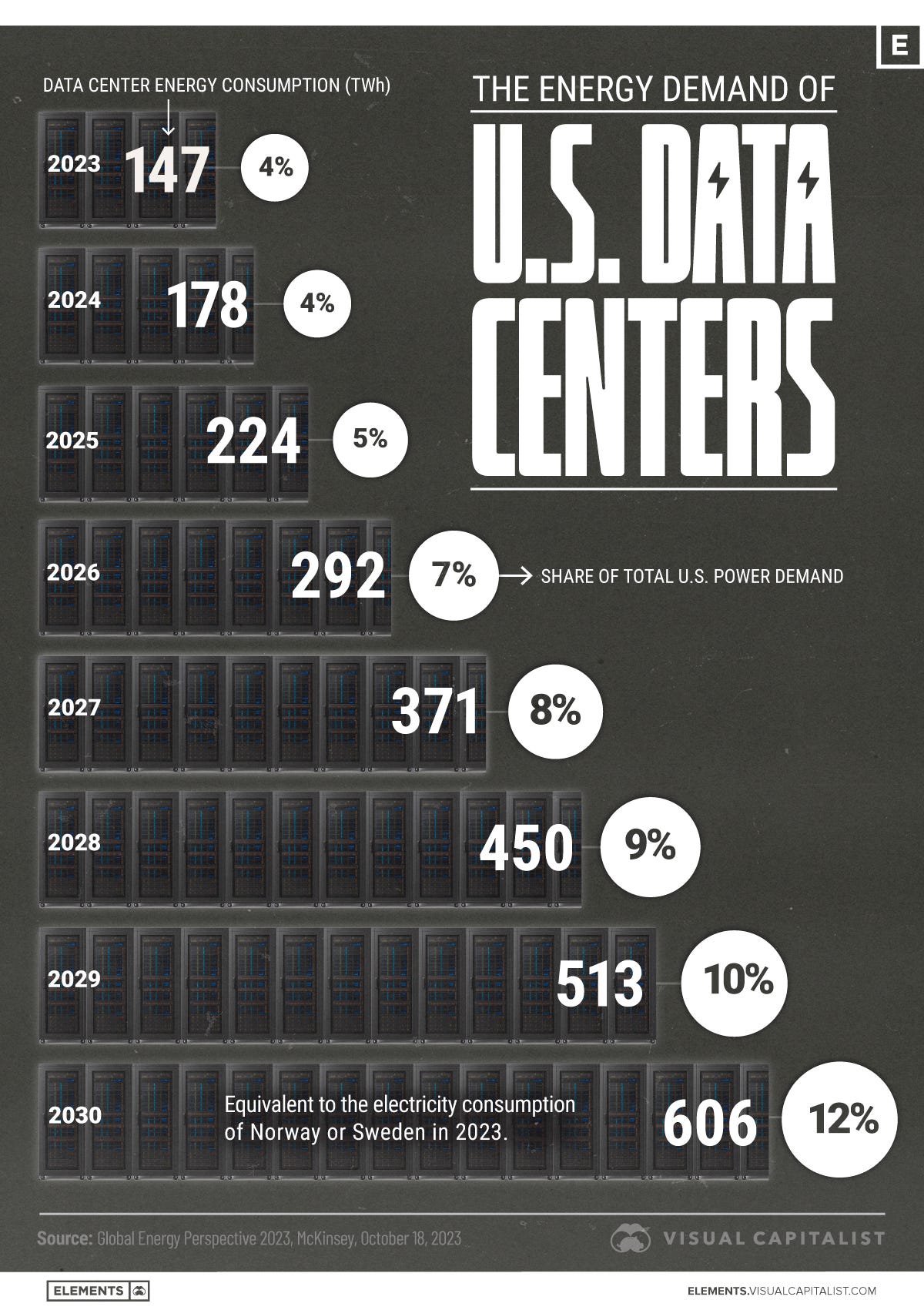

到2030年,僅資料中心就可能消耗美國總電力需求的8%至12%,這是一個驚人的增長速度,遠超過傳統電力公司數十年來的負載預測模型 。這種需求不僅規模巨大,更具備三大特性,對現有能源體系構成嚴峻挑戰:

即時性(Immediacy): AI競賽的時程以月計算,資料中心開發商需要在 2-3 年內獲得數百 MW 甚至數 GW的電力供應,然而傳統電廠的規劃與建設週期則長達 10 年。

集中性(Concentration): AI資料中心園區通常是高密度的電力負載點,單一園區的電力需求可與一座中型城市匹敵。這種巨大的「點狀負載」對區域電網的穩定性和容量帶來極端考驗。

可靠性(Reliability): AI運算任務價值高昂,任何電力中斷都可能造成數百萬美元的損失。因此,資料中心要求接近100%的電力可用性。

在這樣的背景下,傳統電網基礎設施和以間歇性為特徵的再生能源(如太陽能和風能)顯然無法單獨滿足此類嚴苛需求 。電網升級緩慢,跨區輸電項目面臨複雜的監管審批;而再生能源則受制於天氣條件,無法提供AI所需的全天候不間斷電力。因此,市場迫切需要一種能夠快速部署、穩定可靠且能與再生能源互補的「橋接能源」。

天然氣發電,特別是採用現代高效燃氣渦輪機的發電方案,已成為滿足此一需求的關鍵核心。相較於傳統燃煤發電,天然氣發電的碳排放量可減少約一半 。更重要的是,其具備快速啟動、靈活調度和高達99.9%的運行可靠性等優點,使其成為支撐AI資料中心大規模用電需求的理想選擇 。幾乎所有新建的大型AI資料中心,無論是直接自建電力設施,還是由電力公司為其配套建設,都將天然氣發電廠視為核心解決方案 。這場由AI引發的能源需求革命,實質上開啟了一個以天然氣發電技術為核心的能源基礎設施建設的「超級週期」,而GE Vernova(GEV)正處於此週期的絕對中心。

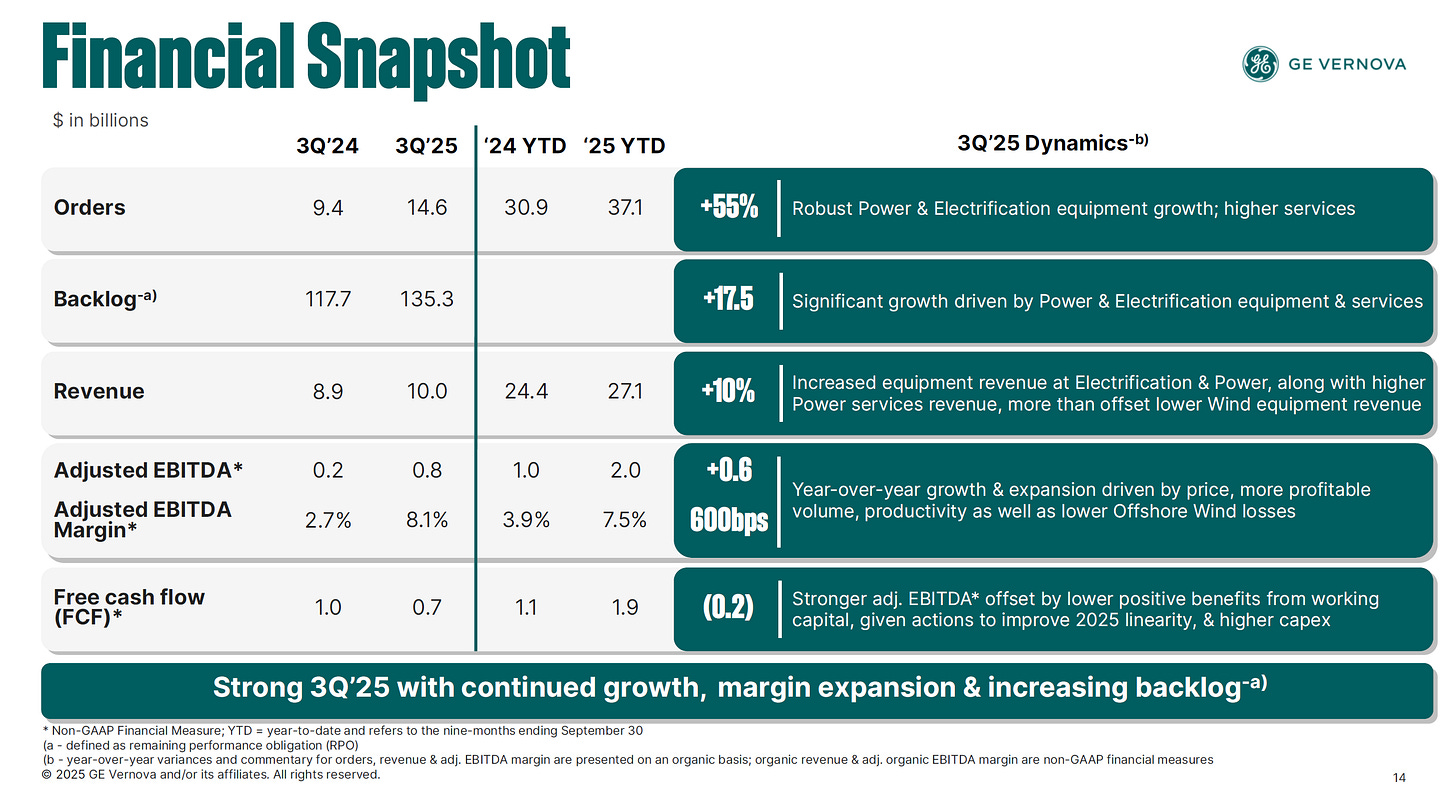

剖析GE Vernova 2025 Q3財報:財務數據的鐵證

財報顯示,GE Vernova在2025年第三季度的總訂單金額達到146億美元,實現了55%的驚人有機增長。積壓訂單(Backlog)單季環比增長66億美元,顯示出源源不斷的業務湧入。這些宏觀數據清晰地描繪出一個正處於高速增長軌道的企業 。

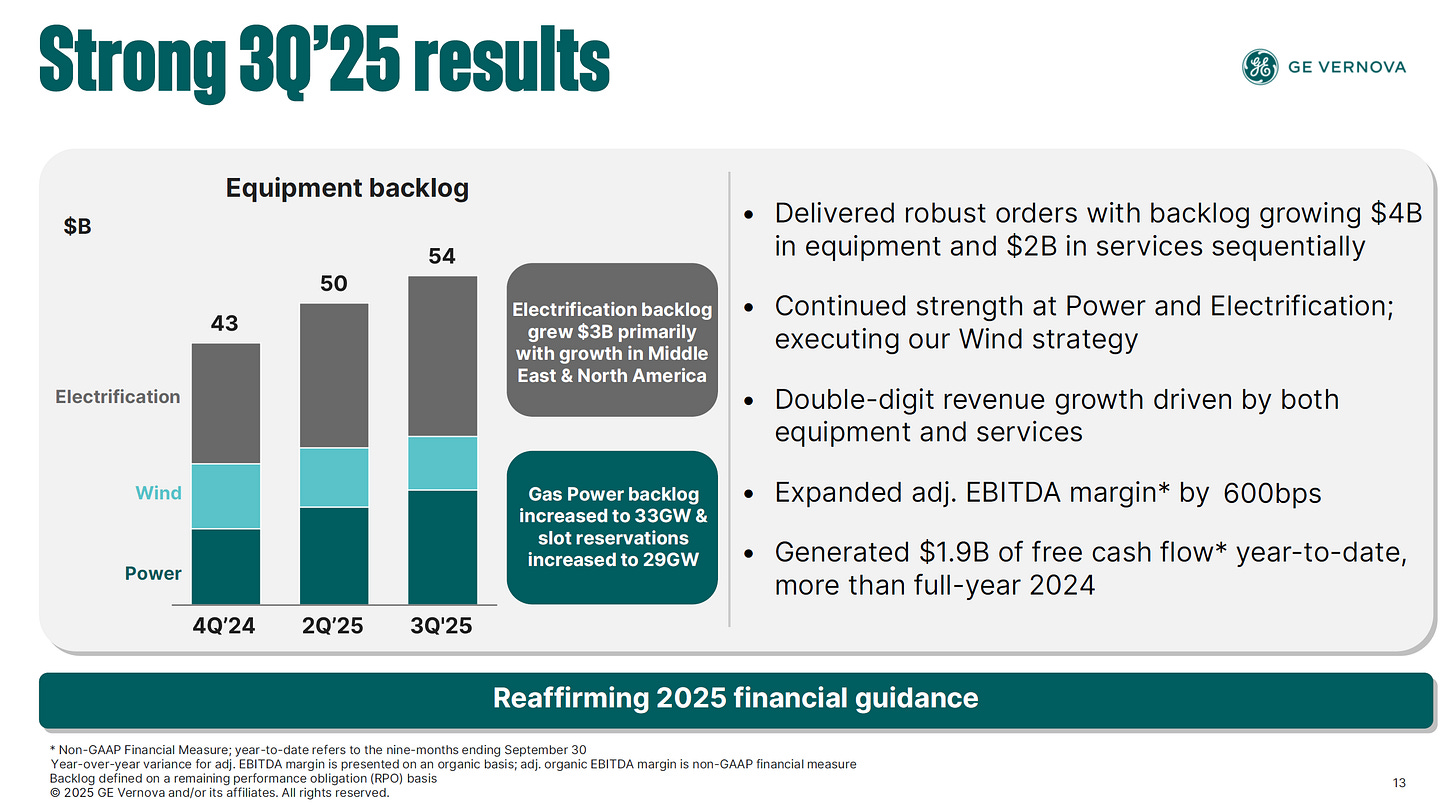

電力事業部(Power Segment): 作為AI浪潮的最大受益者,電力事業部的表現尤為突出。該部門第三季訂單額高達78億美元,有機增長50%。其核心驅動力來自於「燃氣發電設備訂單翻倍以上」,其中包括20台重型燃氣渦輪機,含13台最先進的HA級渦輪機 。 然而,最關鍵的指標是其積壓訂單和產能預留協議(Slot Reservation Agreements)的變化。在單一季度內,GE Vernova的燃氣發電設備積壓訂單與產能預留協議的總量,從55 GW大幅增長至62 GW,淨增7 GW 。為了理解這一數字的份量,7 GW的發電量足以為超過500萬個家庭供電。更細緻地看訂單流轉,公司該季度簽署了超過12 GW的新合約(包括1 GW的確定訂單和12 GW的產能預留協議),同時將7 GW的既有預留協議轉化為確定訂單,並交付了4 GW的設備。這套數據完美展示了一個健康、且正在加速運轉的業務管道 。

電氣化事業部(Electrification Segment): 另一個常被忽視但至關重要的亮點是電氣化事業部。該部門的訂單額飆升至51億美元,有機增長率達到了驚人的102%,主要受電網設備強勁需求的推動 。其營收有機增長32%,而部門EBITDA利潤率更是大幅擴張了550個基點。這表明公司不僅在銷售更多產品,而且擁有極強的定價能力 。 電氣化業務的爆發並非偶然。它與燃氣渦輪機的銷售形成了強大的協同效應。一座燃氣渦輪機如果沒有變電站、變壓器和開關設備等電氣化產品與之配套,就無法將電力輸送給資料中心。客戶在投資數十億美元建設「電力鑄造廠」(Power Foundries)時,傾向於選擇單一、可靠的供應商提供從發電到輸配電的整體解決方案,以降低項目執行的複雜性和風險。GE Vernova憑藉其全面的產品組合,能夠提供這種一站式服務,從而捕獲了整個電力島(Power Island)更大份額的價值。因此,電氣化業務的卓越表現,是燃氣渦輪機銷售熱潮所帶來的直接、高利潤的衍生效益。

戰略悖論:解讀GE Vernova的資本支出立場

面對如此龐大的訂單積壓,為何GE Vernova似乎沒有大幅增加資本支出(Capex)以擴充產能?其2025年Q3的資本支出僅為2億美元,雖然這是其承諾在2028年前投資40億美元計劃的一部分,但單季度的數字相對於146億美元的訂單額而言,顯得相當克制 。

這種看似矛盾的現象,並非GE Vernova缺乏遠見或錯失良機,而是一種經過深思熟慮的、高度理性的商業策略。

行業性的產能約束與歷史教訓

產能緊張是整個燃氣渦輪機行業面臨的普遍問題,而非GE Vernova獨有。目前,訂購一台大型燃氣渦輪機的交付時間已延長至2029年之後 。包括Siemens Energy和Mitsubishi Power 在內的主要製造商,雖然訂單同樣創下歷史新高,但在擴大產能方面都表現得極為謹慎 。

這種謹慎源於歷史的教訓。能源設備製造業具有典型的週期性,過去曾多次因過度擴張產能以應對短暫的需求高峰,而在需求回落後陷入產能過剩、價格崩潰和大規模資產減記的困境。製造商們擔心,當前由AI驅動的需求熱潮,可能是一個持續5到10年的超級週期,但未必是永久性的結構轉變。

一旦AI的能效大幅提升或新的能源技術出現,對燃氣渦輪機的需求可能放緩。在這種不確定性下,耗資數十億美元、耗時數年建設一座全新的先進渦輪機工廠,是風險極高的賭注。

GE Vernova 正用「產能預留協議」管理風險與需求:

「產能預留協議」是此策略中的一個關鍵工具。它允許客戶支付一定費用來預訂未來的生產檔期,但這並非一份具有約束力的確定(Non-binding)訂單。這種機制對GE Vernova有多重好處:

需求過濾器: 它篩選掉了那些資金或項目規劃尚未完全落實的投機性需求,確保積壓訂單的質量。

風險轉移: 在客戶將預留協議轉化為確定訂單之前,GE Vernova無需為其投入大量的資本和供應鏈資源,從而將項目開發前期的不確定性風險留給了客戶。

未來可見性: 大量的預留協議為公司提供了對未來數年需求的清晰視野,使其能夠更精準地規劃供應鏈和生產節奏。

AI 算力的「軍備競賽」正高速撞上多重物理極限,其當前的發展模式在能源、供應鏈及經濟效率上,均面臨嚴峻的可持續性質疑。

能源的「無底洞」 AI 基礎建設對電力近乎無限的需求,已對全球電網和氣候目標構成直接威脅。這不僅迫使資料中心自建天然氣發電站以應對缺口——並將高昂成本轉嫁社會——更現實的瓶頸在於基礎設施的建置速度。電網的接入申請週期漫長,而作為電力緩衝關鍵的天然氣渦輪機組,交付期更超過 48 個月。

供應鏈的「硬瓶頸」 高端 GPU 已成為「21世紀的戰略石油」,引發激烈的地緣政治博弈。然而,瓶頸不僅於此:關鍵的晶圓代工(如台積電)產能難以滿足爆發性需求,連帶的空調與液冷系統也必須提早備貨。更嚴重的是,GPU 3-5 年的高速技術衰減,迫使企業陷入「資本黑洞」,必須持續投入巨額資金更新,財務上難以維繫。

經濟上的「負效益」 這場競賽的驅動力主要並非來自投資回報(ROIC),而是源於「錯失恐懼」(FOMO)。當 AI 服務每創造 1 美元營收,卻需消耗 20 美元資源時(即毛利率為 -1900%),這已觸及經濟效率的「物理極限」。這種負效益的資源燃燒模式,在商業邏輯上顯然無法持續。

從 GEV 財報看見「現實溫度計」 那麼,真實的需求是否如市場情緒般高漲?我們可以從關鍵基礎設施供應商的財報中尋找答案。

以 GE Vernova 為例,其最新的財報提供了一個「溫度計」。作為百年大廠,GEV 面對高漲的積壓訂單,其反應卻相對冷靜克制,並未隨之大幅增加自身的資本支出。這揭示了一個重要信號:GE Vernova 在電力與電氣化的實際營收,才是 AI 算力需求的最先行指標。

GEV 的財報數據與其謹慎的態度,正反映出市場對未來幾年高成長的預期,可能已過於狂熱。

謝謝你的文章,非常受用! GE趨於保守會不會是看到客戶有考慮其他管道的能源? 比如BE的燃料電池,相比渦輪燃燒的發電系統,還要能更快部屬資料中心所用的獨立電網?