Android XR與Google Glass

Android XR 智慧眼鏡,配有顯示螢幕、拍照、傳訊息等功能外,搭載了Google AI助理,能快速理解指令、辨識畫面中的資訊,甚至具有短期記憶

Google I/O 2025開發者大會上發表Android XR智慧眼鏡,強調Android XR結合Gemini AI助理是Google AI策略的重要一環。Google為了全面搶攻AI市場,也在大會上發表Google搜尋引擎 AI Mode,讓使用者以日常對話方式取得網路資訊。

Android XR 平台是什麼?

Google 與 Samsung 正在開發 Android XR 平台,這是一個為可穿戴設備(如 AI 眼鏡)設計的下一代 AR 和 AI 生態系統,專注於可及性和無縫互動。

Gemini 2.0 AI 引擎為該平台提供動力,實現即時上下文覆蓋、語音命令和空間計算,提供沉浸式和自然的體驗。

Google 的 AI 眼鏡輕巧,類似於傳統眼鏡,並配備集成的相機、麥克風和投影能力,用於現實世界和數字互動。

應用包括即時導航、通訊工具和增強記憶,為個人和專業使用架起物理與數字世界的橋樑。

Google 與 Samsung 和 Sony XR 等合作夥伴的協作方式確保了一個統一的生態系統,使其 AI 眼鏡成為與 Meta 和 Apple 等競爭對手的實用主流替代品。

Android XR 平台是 Google 和 Samsung 共同開發的下一代 AR 與 AI 生態系統,專為耳機和眼鏡量身打造,為開發者提供創建沉浸式與實用應用的工具。該平台透過直觀的互動方式,減少用戶操作上的摩擦,讓 AR 與 AI 變得比以往更容易上手與應用。無論是在繁忙的都市中導航、管理複雜的任務,或是簡化日常流程,Android XR 平台都能成為提供更智慧、更多連結體驗的基礎。

藉由這個平台,開發者可以打造無縫融合數位內容與實體世界的應用,進一步提升生產力並豐富人們與技術的整體互動。

Gemini 2.0:AI 的強大引擎

Android XR 平台的核心是 Gemini 2.0 AI 系統,這是一個能夠處理多種輸入的先進引擎,涵蓋語音指令、視覺數據以及上下文提示。該系統運用空間計算技術,確保數位內容與環境的無縫整合,提供自然且沉浸的使用體驗。

例如,Gemini 2.0 可以將即時導航指示或上下文信息,直接投影到眼鏡鏡片上。這種能力強化了與周遭世界的互動,使使用者能在保持專注於物理環境的同時,獲取所需的資訊。透過結合先進的 AI 處理能力與直觀的設計,Gemini 2.0 成為可穿戴技術領域的一項重大突破。

Google AI 眼鏡的主要特點

Google 的 AI 眼鏡在實用性與舒適性方面均經過精心設計,外觀輕巧,與傳統眼鏡相似,確保長時間佩戴時的舒適度,讓其成為適用於多種場景的多功能工具。主要特點包括:

– 集成相機、麥克風和揚聲器:這些組件讓使用者能輕鬆與周遭環境互動,無縫捕捉、溝通並參與各種活動。

– 投影能力:眼鏡可將影片、界面與空間資訊直接顯示在鏡片上,營造沉浸式且互動的體驗。

– 混合焦點:設計確保使用者在不失去對物理世界視野的情況下,即可取得所需的數位資訊,帶來平衡且直觀的使用體驗。

這種兼具功能與舒適性的設計,使這款眼鏡成為個人與專業使用者的理想解決方案,搭建起技術與日常生活之間的橋樑。

XR 技術的應用

Android XR 平台支援多種應用場景,能滿足間歇性和持續使用的需求,展示出 XR 技術的多樣性以及提升生活各個面向的潛力:

– 間歇性耳機:適用於沉浸式 3D 環境,如虛擬工作空間、遊戲或培訓模擬。

– 全天候眼鏡:適合即時協助,涵蓋導航、溝通以及在動態環境中獲取上下文資訊。

例如,在繁忙的城市中導航時,眼鏡可以將逐步導航指示投影到鏡片上,協助使用者保持方向感,無需時時查看手機。同樣,在專業環境中,它們也能即時提供關鍵資訊,簡化工作流程並提升效率。

與 Samsung 和其他合作夥伴的合作

Google 與 Samsung 及其他硬體供應商(如 Sony XR)的合作,突顯了統一生態系統的重要性。透過與這些行業領導者的深度合作,Google 確保硬體、軟體和使用者體驗之間實現無縫整合。這種協作不僅加速了技術創新,還促進了強大的開發者社群,讓各式應用能更貼近使用者的實際需求。

藉由這些合作,Google 不僅推進了 AR 和 AI 的技術能力,更確保它們對不同用戶都是可及且實用的。這種對合作的重視,凸顯了公司致力於提供協調且友善的使用體驗的堅定承諾。

潛在用例:提升日常生活

AI 眼鏡的潛在應用廣泛多樣,提供簡化並豐富日常生活的解決方案。以下是這些眼鏡如何改變人們與技術互動的一些實例:

– 即時導航:在視野中投影方向指引,讓使用者即使在陌生地點也能輕鬆導航。

– 通訊工具:語音轉文字的即時轉錄與翻譯等功能,讓溝通更為簡便,提升無障礙使用體驗。

– 增強記憶:透過空間化的 AR 體驗,像是在拍攝地點疊加照片或影片,讓回憶重溫更加沉浸。

這些應用展示了 AI 眼鏡如何成為連結數位與物理世界的橋樑,讓技術更直觀、更易於使用。透過將 AR 與 AI 集成到可穿戴設備中,Google 為人們開啟了全新的互動方式,進一步提升生活的便利性與功能性

Google 如何與競爭對手較量

Google 對 AI 眼鏡的願景與 Meta、Apple 等競爭對手的努力相仿,他們同樣致力於將 AR 和 AI 融入可穿戴設備中。Meta 的 AR 眼鏡與 Apple 的 Vision Pro,都旨在打造沉浸式且實用的體驗。然而,Google 對可及性與實用功能的特別重視,使其在競爭中脫穎而出。

藉由優先考慮輕巧設計與切合實際的應用,Google 目標是讓 AI 眼鏡成為主流日常工具,而非僅限於小眾市場。這種對可用性的堅持,確保技術不僅具備創新性,還能真正融入日常生活,進一步鞏固了 Google 在可穿戴技術領域的領導地位。

當前進展和未來前景

目前,Google 的 AI 眼鏡仍處於晚期原型階段,尚未向公眾推出。然而,Google 對創新與合作的承諾顯示,這些眼鏡很可能不久後就會成為日常生活中的主流產品。結合 AR、AI 與可穿戴技術,Google 構想出一個更加自然、直觀,並能與周圍環境無縫結合的未來計算方式。

隨著這些眼鏡的開發持續推進,潛在的新應用和用例也不斷湧現。從提升工作效率到簡化日常任務,Google 的 AI 眼鏡正代表著可穿戴技術進化的一個重要里程碑。

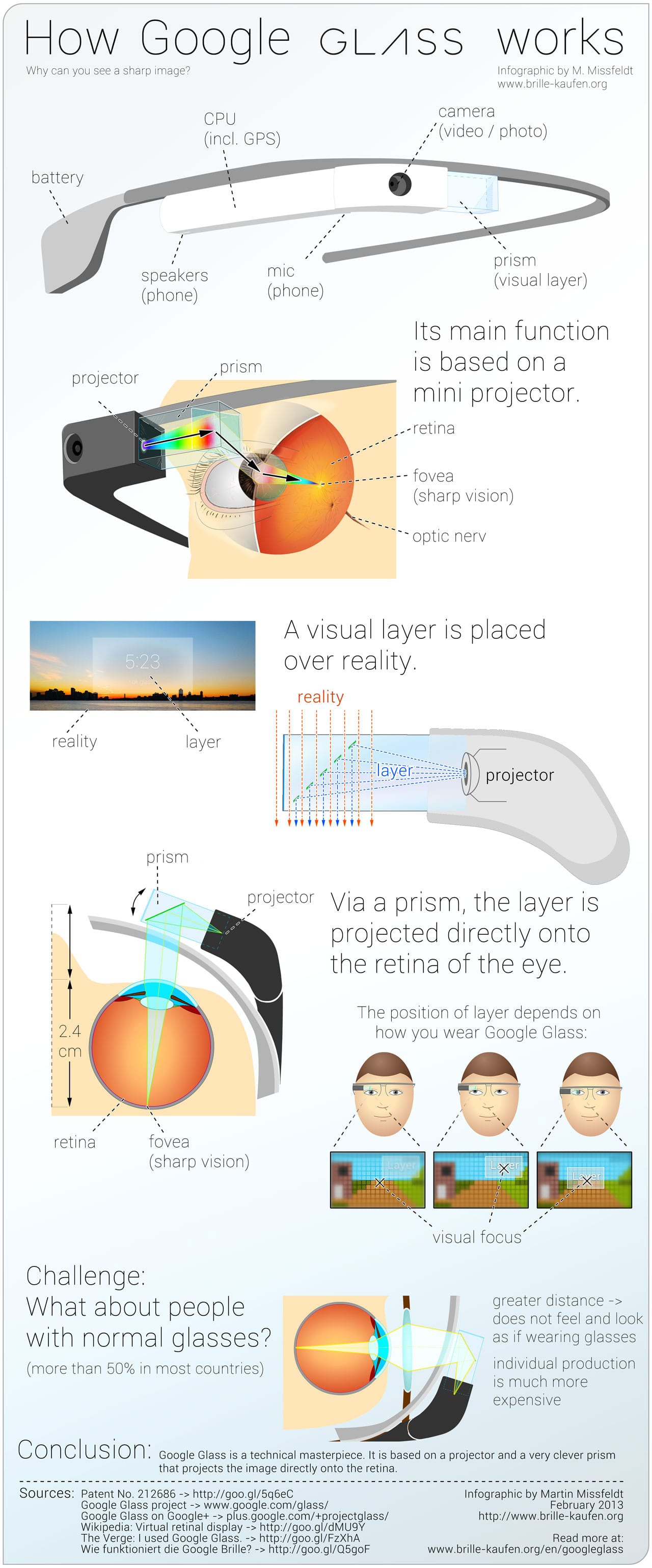

Google Glass 運作方式解析

硬體結構

CPU (包含 GPS):負責數據處理及定位功能。

相機 (camera):可拍照或錄影。

電池 (battery):提供裝置電力。

麥克風 (mic):語音輸入功能。

揚聲器 (speakers):提供聲音輸出(如語音、音樂等)。

稜鏡 (prism):視覺層的投射媒介。

投影顯示原理

Google Glass 的核心技術是 微型投影機。其運作過程如下:

微型投影機 會生成虛擬畫面,稱為 「視覺層」(visual layer)。

這個「視覺層」會經由 稜鏡 投射到使用者的視網膜。

視網膜 內的 中央凹 (fovea) 負責最清晰的視覺成像。

因此,畫面看起來就像懸浮在使用者視野中的一層資訊,與現實世界完美融合。

如何結合真實畫面

Google Glass 的投影原理讓虛擬影像疊加在現實畫面上:

透過稜鏡,投影機產生的畫面(圖層)會直接映射到眼球的 中央凹(最敏銳的成像點)。

使用者的雙眼會自動「融合」現實景象和虛擬資訊,形成 擴增實境 (AR) 效果。

視覺焦點與配戴位置

若 Google Glass 配戴位置對準瞳孔,投影層正好對準中央凹(畫面銳利清晰)。

若位置偏移,畫面可能模糊,或者眼睛的視野聚焦不到虛擬畫面。

眼鏡族群的挑戰

一般眼鏡 會在視覺路徑上增加距離,造成虛擬畫面看起來變遠、變模糊。

這需要 Google Glass 進行 客製化製作(以符合度數、距離等),因此會更昂貴。

Google Glass 利用微型投影機和稜鏡,將數位圖層直接投射到視網膜上,結合現實世界,達到 AR 效果。

其技術關鍵在於:

微型投影機。

稜鏡引導光線,確保畫面聚焦到中央凹。

眼睛的自動融合與視覺適應。

這項結合微型投影機與稜鏡的技術,讓 Google Glass 能在不遮擋真實視野的前提下,將虛擬資訊精確呈現在使用者眼前。憑藉眼睛的自然適應與自動融合能力,這種設計提供了流暢且直觀的增強現實體驗,為未來的可穿戴設備應用開創了新的可能。