Microsoft 的「騰籠換鳥」戰略:是主動還是被動

從 SemiAnalysis 到 Dwarkesh Podcast:巨頭CEO 主動上節目,經常是給自己一個澄清或洗白的廣告時間,如何平衡看待 Microsoft CEO Nadella 的策略轉變?

本文深入拆解 Microsoft 在 2024 年啟動的 AI 戰略「大暫停」(The Big Pause),指出此舉不僅是基於「反脆弱」(Anti-fragile)心法的財務風險控管,更深層的原因,是微軟在自研硬體(Maia 晶片)遭遇重大挫敗後,被迫進行的一場結構性「騰籠換鳥」。

本文定義的「騰籠換鳥」具有雙重含義:

硬體層:騰籠與換鳥

騰籠:

放棄原本試圖追趕 Google、依賴自研晶片(Maia)實現垂直整合的戰略。該路線在裸機(Bare Metal)部署上效率低落,既燒錢又笨重,不足以支撐超大規模 AI 集群的迭代速度。

換鳥:

轉向利用自身在網路架構上的壓倒性優勢(如 Rail-Only 拓撲),打造「可互換艦隊」(Fungible Fleet)。此戰略使微軟不再與 Nvidia 或 AMD 綁死,而是成為所有硬體的「管理者」而非「追隨者」。透過實現真正的「硬體無關性」(Hardware-Agnostic),微軟將 GPU/ASIC 商品化,讓所有競爭對手的晶片都能被其即插即用。

軟體層:騰籠與換鳥

騰籠:

擺脫深度依賴單一模型供應商(OpenAI)的被動地位。隨著 OpenAI 與 Oracle、CoreWeave 等建立更多合作,微軟作為「單一前沿模型供應商」的風險日增。

換鳥:

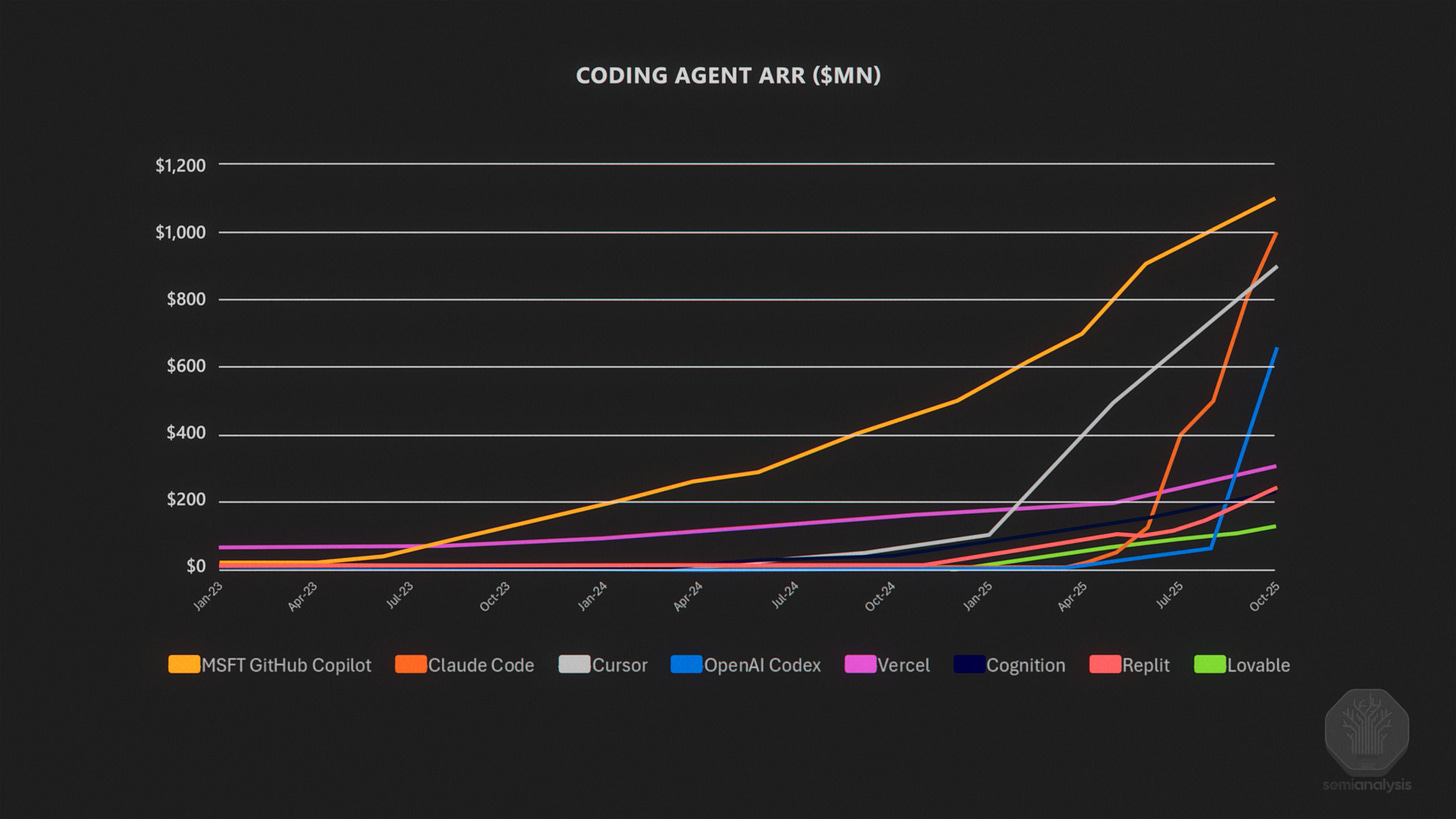

透過「Agent HQ」戰略,將 GitHub Copilot 從「AI 工具」提升為未來所有 AI Agent 的「總管平台」。這是微軟的核心陽謀:藉由掌握生態系統規則,使 OpenAI、Anthropic、Google 等模型全面「商品化」(Commoditized),從而構建「模型無關性」(Model-Agnostic)的終局。

結論

微軟的目標不是在短期的 AI 軍備競賽中勝出,而是在 AI 泡沫(若發生)退潮後,成為唯一站著的「長期倖存者」。

微軟正在打造的是:

AI Agent 運作的基礎設施(Azure / M365)

AI 生態系統的規則制定權(Agent HQ)

最終將自身從「供應鏈被動者」轉變為「生態系統主導者」。

戰略基石—M365 與 Azure 是 AI Agent 時代的終局性護城河

微軟的 AI 戰略並非始於 ChatGPT,而是來自其深厚的企業基盤。其真正的核心,是將 Microsoft 365(M365)與 Azure 從「人類員工使用的工具」,升級為「AI Agent 的工作環境」。

「贏家的詛咒」:為何模型註定被商品化(Commoditied)

Nadella 對 AI 產業的價值分佈有著深刻的哲學思辨。他提出了「贏家的詛咒」 (Winner’s Curse)理論 。此理論認為,儘管頂級的 AI 模型公司(如 OpenAI)持續驚人的創新,模型已淪為商品(Commodities),Apple 測試了所有主流模型,得出的結論是它們本質上大同小異。。

企業用上一個開源模型,加上企業獨特的數據和場景化工程,就能創造出巨大的價值 。這意味著,模型的「智能」本身將迅速變得普及且廉價。Nadella 判斷,最終的價值將分布在模型層和「場景層」(Scenario Layer)。

上述的洞見是微軟整體戰略的邏輯起點:如果模型注定被商品化,那麼將公司的未來與OpenAI 進行長期、排他性的綁定,將是極具風險的。 微軟必須在模型之外,建立其無法被複製的價值。

從「人類工具」到「Agent 基礎設施」

Nadella 在 Dwarkesh 的訪談中清楚描繪:

即便未來 AI Agent 完全自主,它仍需要:

一個「計算平台」(Windows/Microsoft 365)

一個「檔案系統」(OneDrive)

一個「身份系統」(Azure AD)

一個「可觀測性工具」(Azure Monitor)

也就是說:

微軟過去 40 年打造的 IT Stack,將無縫轉譯成 AI Agent 的數位工作辦公室。

未來不是賣軟體訂閱,而是賣「AI 員工的工作環境」。

Microsoft 365 與 Copilot:微軟最堅固的場景層護城河

Copilot 的壁壘不來自模型能力,而來自:

全球 10 億 Office 用戶

40 年累積的企業工作流整合

深度部署與生產力場景綁定

Nadella 的說法是競爭對手(例如 Google),即使能訓練出更強大的 AI 模型,也無法在短期內複製微軟過去四十多年來在全球企業工作流程中所建立的「部署基礎」 (Word、Excel、PowerPoint 和 Teams,Nadella 不斷強調 Excel 的無可取代性,因為企業通常已內建龐大的 VBA 函式庫,這是各個企業的核心競爭優勢)。當 AI 的能力需要透過 體現時,微軟就掌握了 AI 價值的最終實現戰場。。

微軟真正掌控的是:

AI 價值執行的最後一公里。

從輝煌轉向危機—「綁定 OpenAI」與「裸機陷阱」

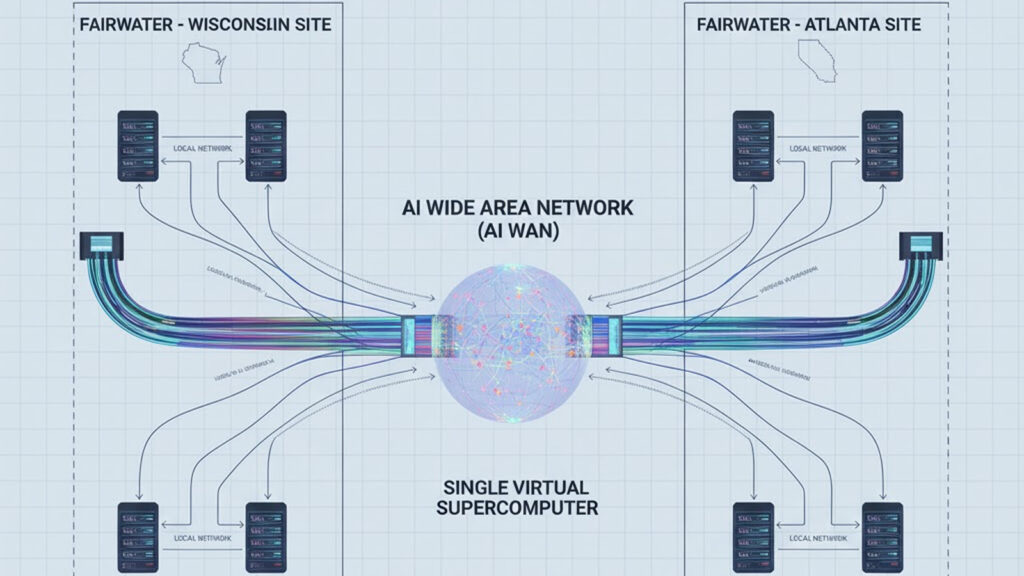

2023 年的微軟處於輝煌巔峰,從 10 億擴大到百億投資,並啟動 Fairwater 與廣泛部署 A100/B100 的大型集群。

但 2024 年突然踩下「大暫停」。

2023:從 10 億到 100 億的槓桿

微軟與 OpenAI 的緣分始於 2019 年的 10 億美元投資,但在 2023 年初 ChatGPT 爆發後,微軟迅速將賭注提升至百億美元級別 。這筆投資為微軟換來了至關重要的回報:對 OpenAI 前沿模型的優先、深度商業化授權,以及作為其首選雲平台的地位 。

為了支撐這項合作,微軟啟動了 Fairwater 的超大 AI Cluster 計畫 。微軟初期目標明確而純粹:為 OpenAI 的模型訓練和推理,提供源源不斷的動力。2023 年,這條「深度綁定 OpenAI + 大規模算力擴張」的路徑,被視為微軟統治 AI 時代的「黃金賽道」 。

這條路徑在 2023 幾乎無人能敵。

危機浮現:「大暫停」的真實觸發點

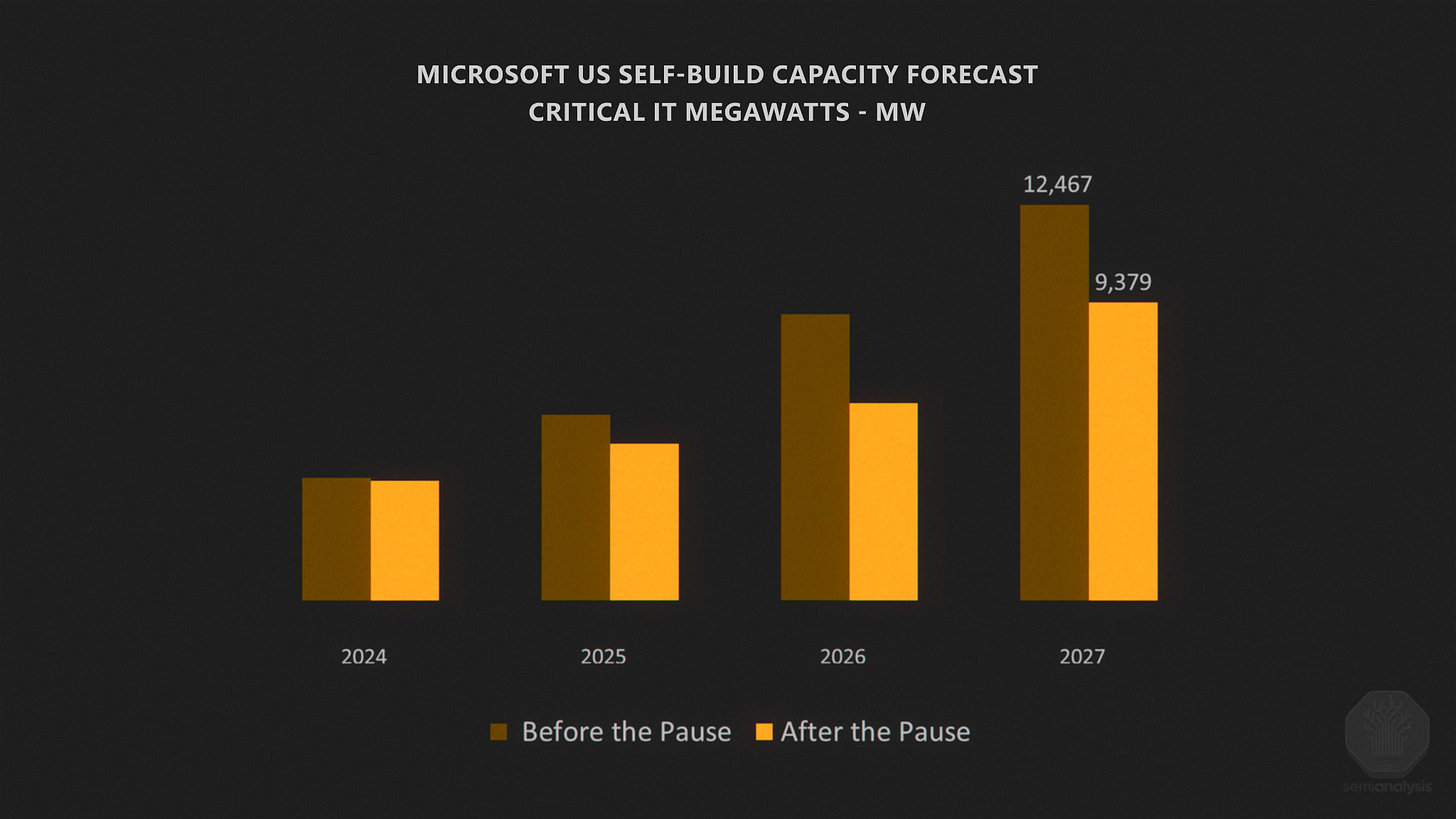

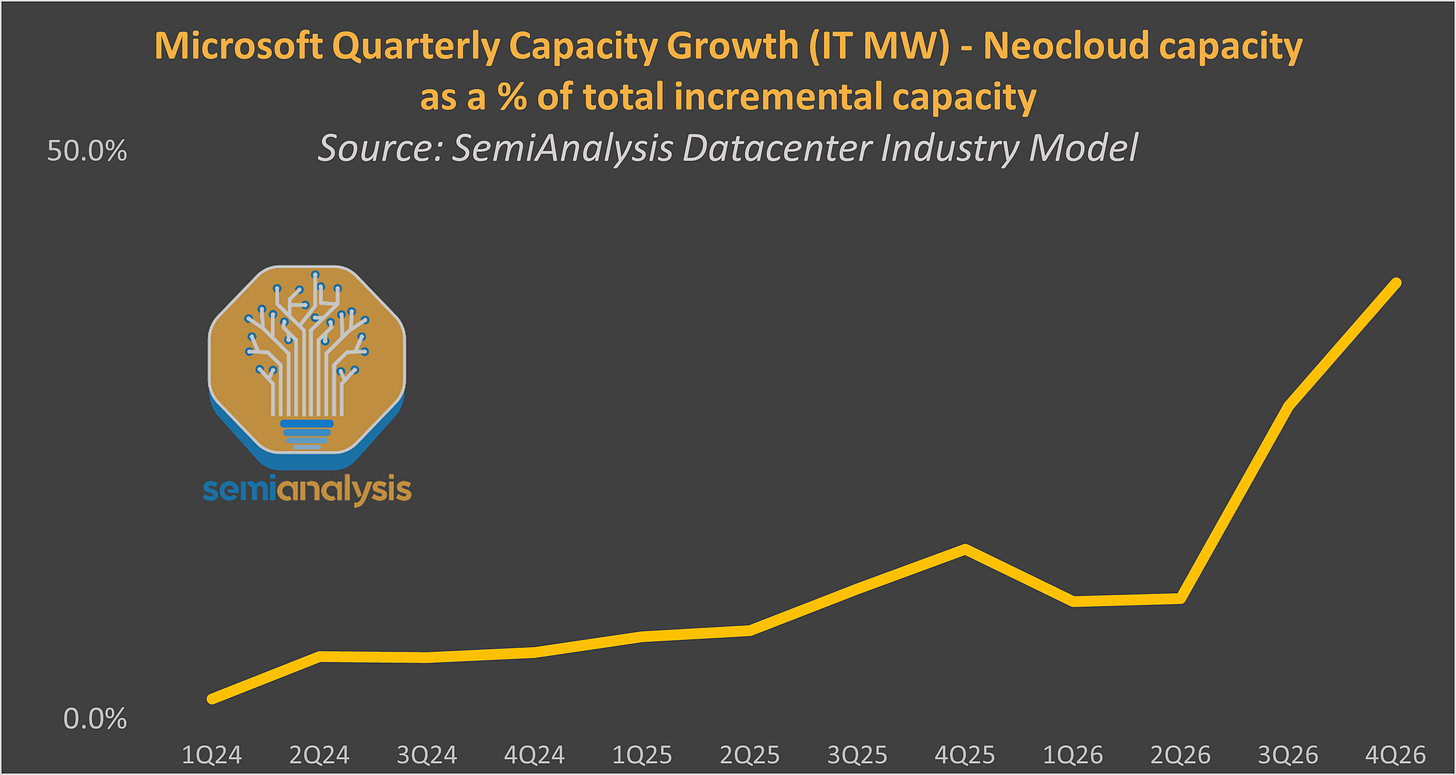

然而,就在 2024 年,微軟突然在這條黃金賽道上踩下了「大暫停」。高達 1.5 GW 的自建項目放緩,超過 3.5 GW 的租賃合同被取消 。微軟在資料中心預租賃容量的佔比從 60% 驟降至 25% 以下 。

Satya Nadella 將此舉包裝為一次主動的、基於「可互換性」哲學的戰略轉向 。然而,分析顯示,「大暫停」看似主動布局,更似一系列迫在眉睫的危機所觸發的被動反應。

觸發點一:執行力災難與 OpenAI 的「背離」

最直接的警報來自微軟的組織執行力 。當時與 OpenAI 規劃在威斯康星州的 Stargate 項目, 2023 年 9 月動工後,到 2025 年仍未正式投入運營 。微軟這個數十萬員工的巨型組織,在流程複雜性與決策速度上,暴露了其在應對 AI 基礎建設時的嚴重短板 。

相比之下,其競爭對手 Oracle 在德州 Abilene 的資料中心,2024 年破土動工,2025 年年中即有兩個 building 開始運營 。面對算力需求的月度增長,OpenAI 的耐心消耗殆盡,最終轉而牽手 Oracle、CoreWeave、Amazon 和 Google 。這一系列事件,標誌著微軟失去了「獨家供給」地位,從「獨家合夥人」降級為「供應商之一」。

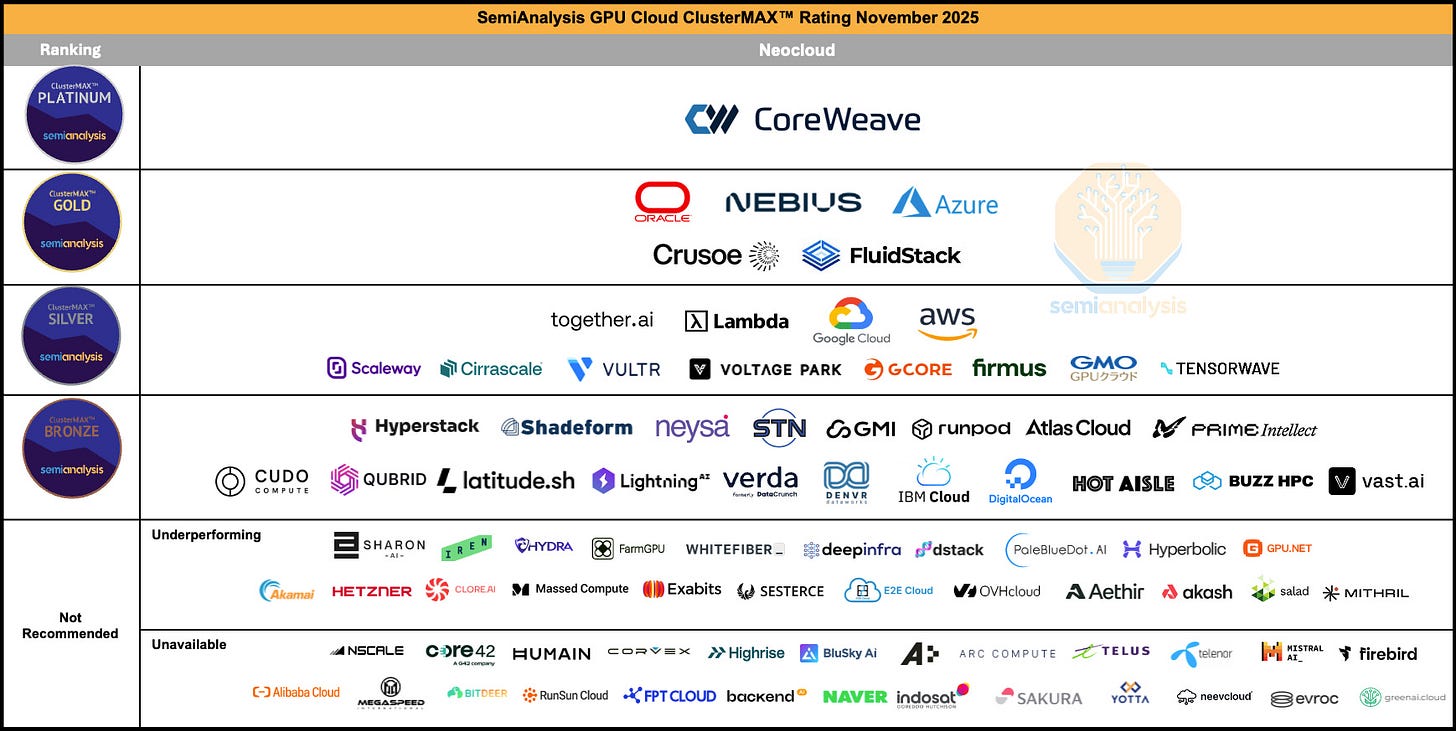

觸發點二:商業模式的根本衝突 (Hyperscale vs. Neocloud)

更深層次的原因,在於微軟的核心商業模式與 OpenAI 的需求之間存在根本衝突 。

微軟 (Hyperscale 模式): 其核心是「服務」 (Service) 與「複用」 (Reusability)。微軟透過複雜的虛擬化和軟體層,將物理資源切割、隔離、安全地分配給成千上萬個不同的企業客戶。其資產是高度「可複用」的 。

OpenAI 的需求 (Neocloud 模式): OpenAI 的需求本質上是「商品」 (Commodity) 與「專用」 (Dedicated) 。它需要的是未經虛擬化、追求極致性能的裸機 (Bare Metal) 算力 。

這種裸機需求對微軟而言是低利潤、高風險的。一旦 AI 泡沫破裂,OpenAI 無法履約,這些為其「專用」需求配置的硬體(例如特定的網路拓撲和機架設計),將很難被微軟那些高利潤、高安全需求的「基本盤」企業客戶所複用。

觸發點三:殘酷的財務計算 (基本盤 vs. 泡沫)

來自財務和資源分配的冷酷計算。

為 AI 泡沫準備「退路」: 隨著 Nvidia 市值突破五萬億美元,AI 泡沫論調不絕於耳。Nadella 必須為泡沫破裂準備「退路」。如果微軟將所有 Capex 都投在滿足 OpenAI 當前的指數級需求上,一旦需求斷崖式下跌,微軟將背負數百億無人問津的專用算力資產和巨額財務折舊 。

避免擠壓「基本盤」客戶 : 更緊迫的是,GPU 緊缺已經開始擠壓到微軟真正的「衣食父母」—— 遍布全球的財富 500 強企業。這些客戶貢獻了穩定、高利潤的收入 。為了滿足 OpenAI 這個低利潤、高風險的客戶,而得罪成千上萬高利潤、高黏性的基本盤,在微軟看來無疑是自毀長城。

✅為 Neocloud 說句公道話,平衡 Nadella 的說法

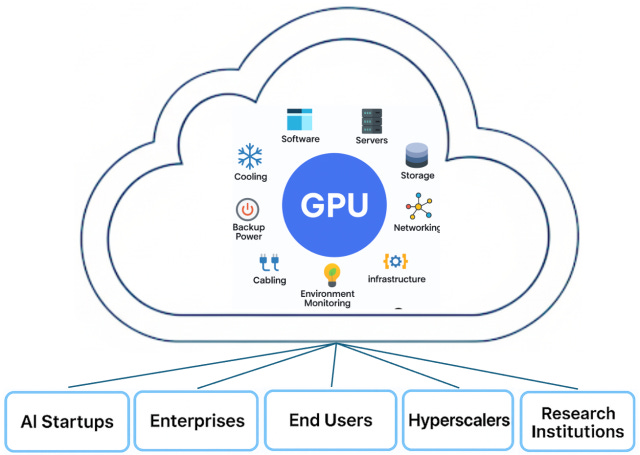

前陣子和一位新創創辦人聊到,他在 AI 基礎設施上砸了將近 40 萬美元,最後卻不得不放棄。他的團隊點子極好,但完全負擔不起把想法實現所需的算力。這絕不是個案。

當 hyperscalers 正為打造超大規模 AI 資料中心投入數百億美元時,其餘的創業者與中小企業,在部署客製化 AI 解決方案時面臨的卻是殘酷的現實。

光是透過傳統雲服務租用 四台 Nvidia H100 GPU,一個月的成本就可能超過 30 萬美元。如果再把冷卻系統、配電、專用網路架構等複雜度加進來,你很快就能理解為什麼大多數創新者連踏入門檻都做不到。

傳統的Plateform as a Service(PaaS)也幫不上多少忙。

✅Neocloud:AI 基礎設施的新破壞者

如果說傳統資料中心像是一家成本龐大的大型餐廳,那 neocloud 就像雲端世界裡的 行動餐車:靈活、專門,並且能在你需要的地方快速部署。

我們看到多家 neocloud 供應商,它們的商業經濟性令人驚訝。若以完全相同的 H100 規格比較,neocloud 的成本通常比 hyperscaler 低 60–70%。

✅Neocloud 其實才是「遊戲規則改寫者」

1. 他們徹底消滅了複雜性:將部署周期直接從「數月」縮短到「數天」。

2. 他們砍掉了拖累效能的虛擬化層:傳統雲為了多租戶隔離,存在多層虛擬化,而 neocloud 採的是接近裸機(bare metal)的架構。因此 AI 工作負載可以以 原生速度 運行,不會有虛擬化管理程式造成的性能稅。

3. 他們真正掌握了「無繁文縟節」的擴展性

Maia 的失敗—硬體層被迫「騰籠換鳥」

一個更深層、更具決定性的內部挫敗,才是迫使微軟必須進行戰略轉向(騰籠換鳥)的真正內幕:其自研 AI 晶片 Maia 計畫的實質性失敗。

自研晶片 Maia 的「坎坷之路」

微軟深知,要擺脫對 Nvidia 的依賴並在成本上與 Google、Amazon 競爭,自研晶片是必經之路。然而,微軟在這條賽道上「顯著落後」 。

內部評估: 微軟的自研 ASIC 晶片 Maia 系列進展緩慢。Maia 100 部署規模相對有限,而 Maia 200 的流片與量產明顯慢於預期。

外部驗證: 近期的行業報導證實了這一挫敗。代號為 Braga 的 Maia 200 晶片,其大規模生產已從原定的 2025 年推遲到 2026 年 。延遲的原因包括意外的設計變更和技術挑戰 。

致命的性能差距: 更糟糕的是,多方消息指出,即使 Maia 200 在 2026 年推出,其性能預計仍將落後於 Nvidia 的 Blackwell 晶片 。

Maia 的失敗,在與競爭對手的對比中顯得尤為刺眼

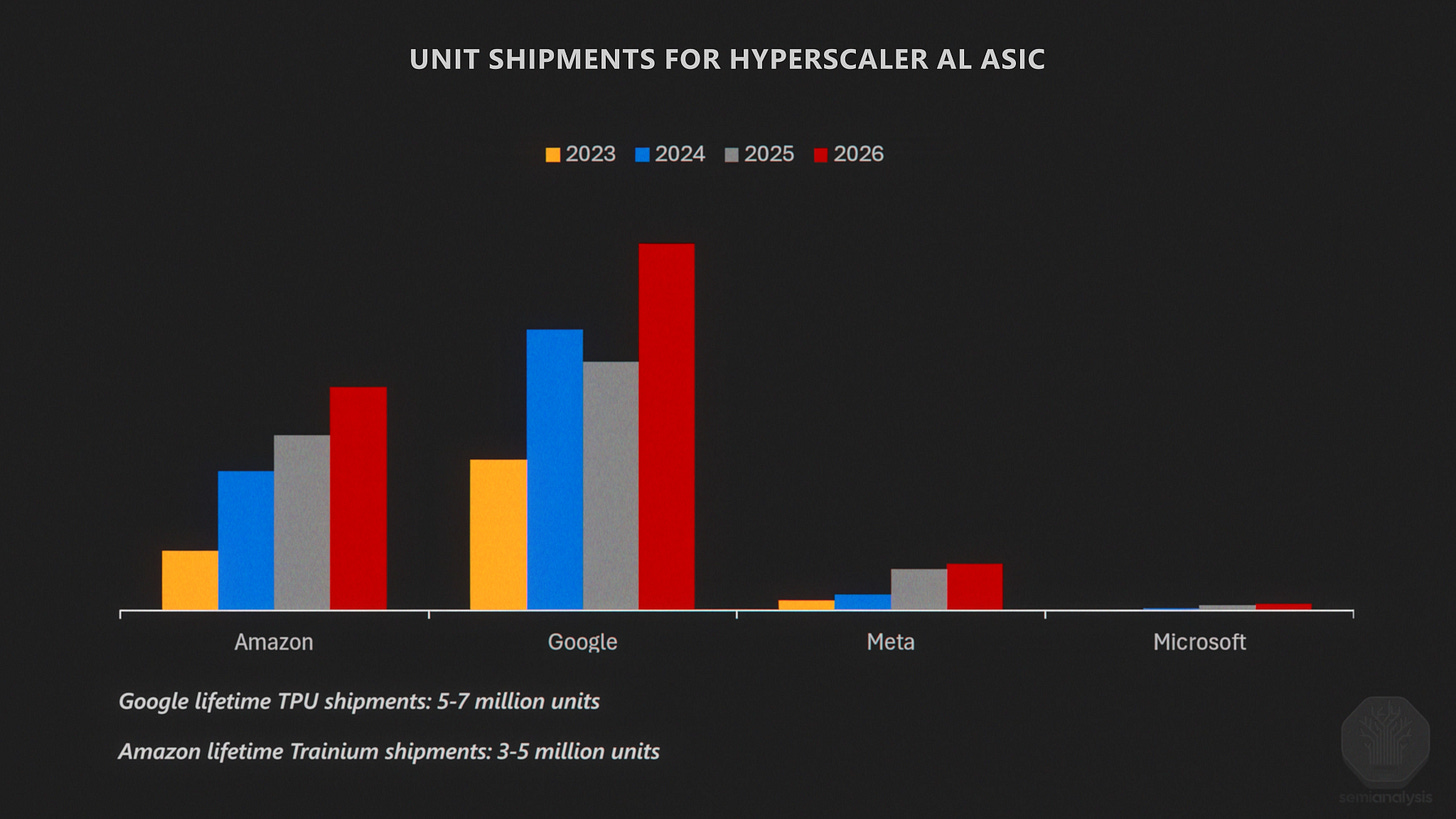

Google: 憑藉其成熟的 TPU,Google 實現了高效的「晶片-模型-雲」垂直整合。其 TPU 的卓越性價比,甚至迫使 Anthropic (微軟的另一家 AI 合作夥伴)也成為其主要客戶 。

Amazon:自研的 Trainium 晶片早已實現了規模化部署,顯著優化了成本和功耗,為客戶提供了 GPU 之外的可靠選項 。

「大暫停」發生的 2024 年,恰逢微軟內部確認其 Maia 晶片延遲、且性能無法達標的壞消息之時。微軟高層意識到,其在「垂直整合晶片」這條賽道上已經實質性失敗,無法追上 Google 和 Amazon,更遑論擺脫 Nvidia。

因此,「大暫停」不僅是主動的財務規避,更是被迫的戰略重新校準。微軟必須找到一條不依賴自研晶片也能成功的勝利之路。

轉向「可互換艦隊」(Fungible Fleet)

既然晶片競賽勝利無望——

微軟決定在「晶片使用方式」上勝出,而非「晶片製造」上勝出。

核心是:

所有晶片都可插拔

所有模型都可替換

Azure 成為最靈活的平台,而非最強的晶片製造商

這是一種典型的「反脆弱」策略:

不追求控制變化,而是利用變化。

如何實現「可互換艦隊」?

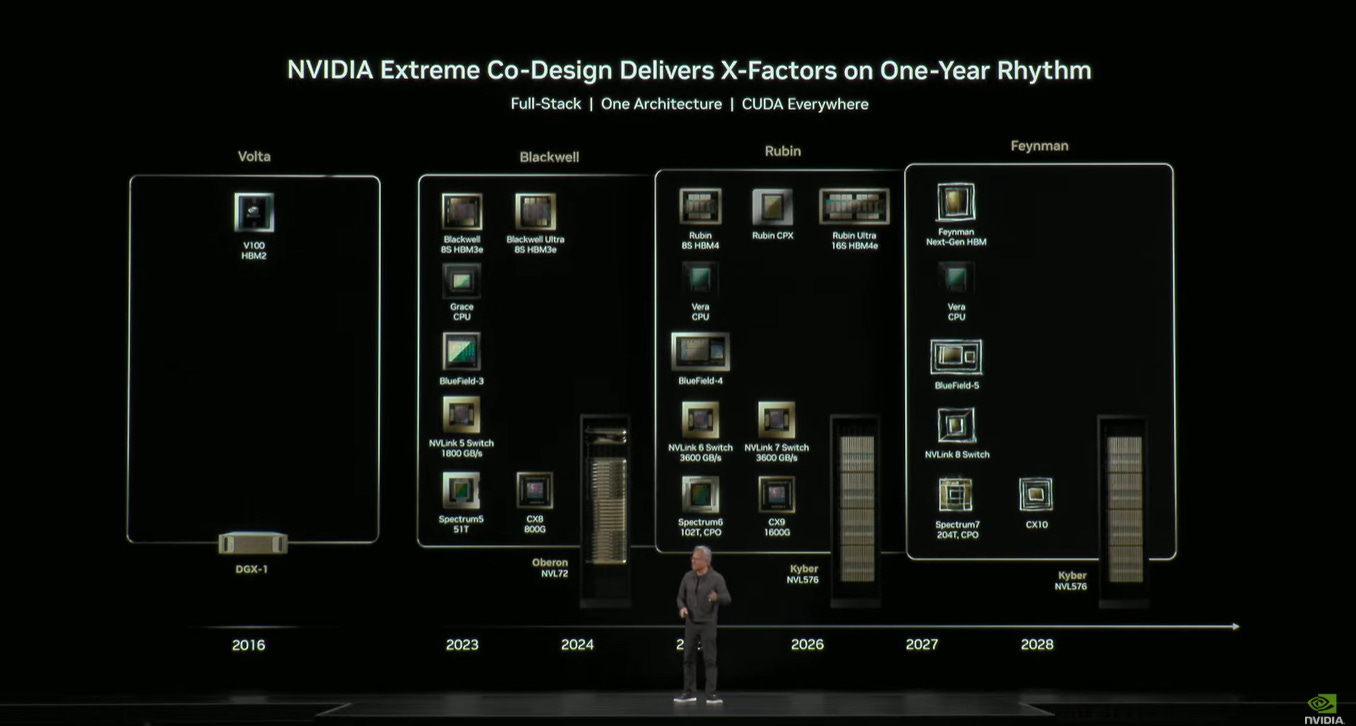

答案是:在「網路」上獲勝。當外界的目光都集中在 GPU 上時,微軟在決定超大規模 AI 集群效率的關鍵——網路架構上,展現了世界級的創新能力 。

微軟採用了高基數交換機和創新的「Rail-Only 拓撲」,實現了從連接 2048 個 GPU 到高效連接超過 50 萬個 GPU 的質的飛躍 。

微軟的長期霸權,是建立在「網路」而非「晶片」上的。晶片每 18 個月就會過時,但網路架構和其上的軟體生態系統可以持續 50 年。

透過「Fungible Fleet」戰略,微軟的角色可望實現根本性轉變:

從被動購買者到主動管理者: 微軟不再是 Nvidia 路線圖的被動接受者。例如,微軟強烈抗拒 Nvidia 透過改變伺服器機架設計(B200 機架)來進行物理鎖定,因為這會妨礙其切換到 AMD 等其他競爭晶片 。

從單一依賴到多元佈局: 微軟轉而積極資助 Neocloud 運營商(如 IREN),向其採購算力,以間接獲取 Nvidia 的 GB300 產能 。

微軟透過將自身定位為所有硬體(Nvidia, AMD, IREN)的主動管理者和最大買家,成功地將這些昂貴的、迭代迅速的硬體,變成了其「可互換艦隊」中的可插拔商品。

軟體層「騰籠換鳥」——從 Copilot 工具到 Agent HQ

硬體層的勝負影響成本;軟體層的勝負決定誰擁有「規則制定權」。

GitHub Copilot 的進化:從工具到總管

微軟正在將 GitHub Copilot 打造成「Agent HQ」(AI Agents 的總管理者)——

掌管未來所有 AI Agent 的:

協同中心

管理平台

生態入口

多模型競價市場

最終使:

OpenAI

Anthropic

Google

xAI

Cognition

都變成 GitHub 的「插件」。

這是軟體層的「騰籠換鳥」本質:

將競爭者變成供應商,將供應商變成可替換資產。

這就是微軟在軟體層的「陽謀」 (騰籠換鳥): 微軟巧妙地將 GitHub 從一個單一 AI 工具提供商(推銷自己的 Copilot)轉變為一個多供應商的 AI 代理市場 。

透過成為這個市場的「協同者」、「管理者」和「規則制定者」,將所有競爭對手 Anthropic, Gemini, …的模型商品化,使其變為可隨時替換的「插件」。

市場的競爭走向,會讓 Microsoft 稱心如意地透過 Github CoPilot 與 Microsoft 365 等實現 AI 自動化的最後一哩路,而順利「騰籠換鳥」,逆轉劣勢為微軟獨特的優勢嗎?

平衡報導:從 Google 的視角看 Microsoft 的 AI 大戰略

Microsoft 目前的 AI 領導地位,主要建立在對單一外部夥伴(OpenAI)的高風險、高成本的策略依賴之上。Nadella 近期(2024-2025 年)提出的策略轉向,即所謂的「大暫停」(The “Big Pause”),並非其所宣稱的高瞻遠矚(建立「可互換艦隊」),而是對其自身執行力瓶頸、高昂「Nvidia 稅」(Nvidia Tax)以及失去 OpenAI 獨家算力合約後 的一種被動反應與務實妥協。

平心而論,Google 不僅是這場當代 AI 革命的技術奠基者,更憑藉長達十年的垂直整合佈局——從客製化晶片到全球分發的應用程式——建立了在 AI 時代中,最具韌性、最具成本效益、且護城河最深的全棧能力。

Google 的優勢是結構性的,體現在四個關鍵層面:

技術原創性: Google 發明了 Transformer 架構,這是所有現代大型語言模型(包括 GPT)的技術基石 。

硬體自主權: Google 長達十年的 TPU 計畫,提供了無可比擬的成本效益與效能,成功規避了對第三方硬體的依賴 。

生態開放性: Google Cloud 憑藉其 TPU 的卓越性價比,贏得了 Anthropic 價值數百億美元的算力協議,證明了其作為開放 AI 平台的強大吸引力 。

分發閉環: Google 獨有的 Search、YouTube 和 Android 生態系統,不僅提供了無與倫比的即時訓練數據,更掌握了觸達全球數十億用戶的終端分發渠道 。

我的看法是,Nadella 的敘事是一種精明的市場溝通,但 Google 的實力根植於深厚的工程底蘊和基礎設施的殘酷現實。AI 是一場馬拉松,Google 已經建立的垂直整合能力,使其在這場競賽中擁有最強大的耐力與長期韌性。

Google 在 AI 和雲端計算上的研發支出是天文數字。僅 2021 - 2023 年,Google 在 AI 和雲端計算領域的投入超過 1000 億美元 。2024 年這個金額則超過 1200 億美元,其中絕大部分用於 Google DeepMind 的基礎研究和 Google Cloud 的基礎設施擴張 。DeepMind 的 Demis Hassabis 已公開證實,Google 在 AI 上的長期投入,將超過 Microsoft 與 OpenAI 的 1000 億美元 Stargate 超級電腦計畫 。

Microsoft 的「精準投資」策略: 相比之下,Microsoft 的 AI 支出(2024 年約 950 億美元) 中,其最引人注目的舉措,均是外部投資。這包括對 OpenAI 自 2019 年以來累計超過 130 億美元的投資 ,以及 2018 年以 75 億美元收購 GitHub 。

Nadella 的動機非常清晰:Microsoft 需要 OpenAI 的 IP 才能在 AI 時代具備競爭力,Microsoft 甚至讓 OpenAI 自己的 IP 來「bootstrap」(啟動)他們 。

Microsoft 在 AI 基礎模型研發上,從一開始就處於追趕地位。Nadella 的「精準投資」是一種高明但防禦性的資本運作,其目的是利用資本,快速彌合其與 Google 之間長達數年的內生 AI 研發差距。Google 的「dedication」體現在 Google Brain 和 DeepMind 數千名研發人員 和數十年的基礎科學投入上;而 Microsoft 的「dedication」則主要體現在其併購與投資團隊的財務操作上。

晶片與基礎設施的殘酷經濟學

AI 競賽不僅是演算法的競賽,更是基礎設施和晶片製造成本的競賽。在這一層面,Google 長達十年的垂直整合佈局,構建了 Microsoft 至今仍難以企及的結構性優勢。

✅Google TPU 的十年佈局

Google 的 AI 策略從一開始就認識到,依賴通用硬體將無法滿足未來 AI 所需的規模和效率。因此,Google 選擇了更艱難但回報更豐厚的路徑:全棧垂直整合。

Google 不僅設計 AI 軟體(如 Gemini)和框架(如 JAX 和 TensorFlow),還自主設計了執行這些任務的核心硬體:TPU (Tensor Processing Unit)。TPU 是專為 Google 的機器學習工作負載而量身定制的 ASIC。

這種「從晶片到軟體框架」的全棧協同設計能力,意味著 Google 可以在硬體層面積累軟體層面的優化。Google 的基礎設施優勢是系統性的,涵蓋了 TPU 晶片、Jupiter 資料中心網路(實現超高頻寬的晶片間通訊)以及 Titanium 卸載晶片(處理網路和I/O)。這種整體設計的效率是其他僅靠採購第三方組件的雲端廠商無法複製的。

自近十年前推出第一代 TPU 以來,Google 的 TPU 計畫已快速迭代。最新的第六代 TPU (Trillium, TPU v6e) 實現了相較於前代 4.7 倍的每晶片算力提升。而 2025 年的第七代 TPU (Ironwood, TPU v7),更是提供了比廣泛部署的 TPU v5p 高出 10 倍的峰值效能,成為 Google 迄今為止最強大、最高效的客製化晶片。

✅規避「Nvidia 稅」

Google 的垂直整合策略,帶來了 AI 競賽中最關鍵的優勢:成本。

「Nvidia 稅」的現實:Microsoft 及其主要夥伴 OpenAI,其 AI 基礎設施嚴重依賴向 Nvidia 採購高階 GPU(如 H100 和 B100)。Nvidia 利用其市場壟斷地位,在其資料中心晶片上享有 75% 以上的驚人毛利率。這意味著,Microsoft 每擴展一分 AI 算力,其成本結構中就有巨額的溢價(被稱為「Nvidia 稅」)流向了其供應商。

Google 透過自主研發 TPU,完全規避了這筆「Nvidia 稅」。Google 獲取和運營其 AI 算力的內部成本,大約僅為其競爭對手向 Nvidia 採購同等高階 GPU 成本的 20%。這轉化為高達 4x 到 6x 的巨大成本效益優勢。

✅Microsoft Maia 晶片的困境

Microsoft 顯然也意識到了對 Nvidia 的過度依賴是其戰略上的阿基里斯之踵,因此也效仿 Google,啟動了名為 Maia 的自研 AI 晶片計畫。然而,這項計畫的進展非但沒有縮小差距,反而凸顯了其在硬體整合上的困境。

根據多方報導,Microsoft 的下一代 AI 晶片 Braga(預計命名為 Maia 200)已確認嚴重延遲。該晶片原定於 2025 年投入量產,現已推遲至少六個月,延至 2026 年。

更具災難性的是,即使 Maia 200 能夠在 2026 年姍姍來遲,其效能預計也將遠遠落後於 Nvidia 在 2024 年底就已推出的 Blackwell (B200) 系列晶片。Microsoft 在這場關鍵的硬體自主競賽中,不僅沒有追上,反而被拉開了更大的差距。

Maia 晶片延遲的背後,隱藏著一個更深層的、具有諷刺意味的因果關係,它完美地暴露了 Microsoft 策略的內在矛盾。

為什麼 Maia 晶片會失敗?延遲是由於「意外的設計變更」、「人員短缺」、「高流動率」以及——最關鍵的——「來自 OpenAI 的最後一刻功能請求」造成的。

這揭示了一個關鍵的戰略困境:

Google 的 TPU 團隊與 Gemini 團隊同屬一個組織(Google DeepMind),他們可以緊密地進行「共同設計」(Co-design),確保硬體和軟體在數年的研發週期中保持一致。

Microsoft 的 Maia 團隊則試圖服務一個外部夥伴(OpenAI),該夥伴的需求和模型架構在以「月」為單位快速迭代。這種不斷變化的外部需求,使得 Microsoft 的晶片設計團隊無法在一個穩定的目標下完成設計,最終導致專案延遲和效能落後。

Microsoft 對 OpenAI 的「策略依賴」直接導致了其「硬體自主」的失敗。Nadella 試圖同時走「外部依賴」和「內部研發」兩條路,結果是兩條路都受到了彼此的掣肘。這完美地反襯出 Google 長達十年、不受外部干擾的垂直整合策略是多麼富有韌性。

真是一篇需要認真思考的文,謝謝作者

感覺MSFT更像一個守城人繼續完善他的城堡(軟體,雲端),雖然我認為他的護城河足夠他繼續強大,但想想未來他的ai硬體和模型都沒有自己的,真的能像他所說的那麼理想嗎🤔

Brilliant. Ecosystem control always beats raw model power.